一只果蝇炸翻 AI 圈!无指令自主觅食,背后藏着 AI 的终极答案

2026年3月7日,美国初创公司Eon Systems在X上发布了一段43秒的视频。屏幕里有一只果蝇在走动,清理触角,寻找食物。

表面上看,这毫无新意。早在几年前,DeepMind就用强化学习训练出过类似的虚拟昆虫。在那场旧实验里,虚拟昆虫经历了千万次跌倒,算法用精心设计的奖励机制教会了它如何迈开腿。

Eon Systems干了一件截然不同的事。他们根本没有写任何关于“行走”或“觅食”的指令。没有任何训练数据。没有任何奖励函数。

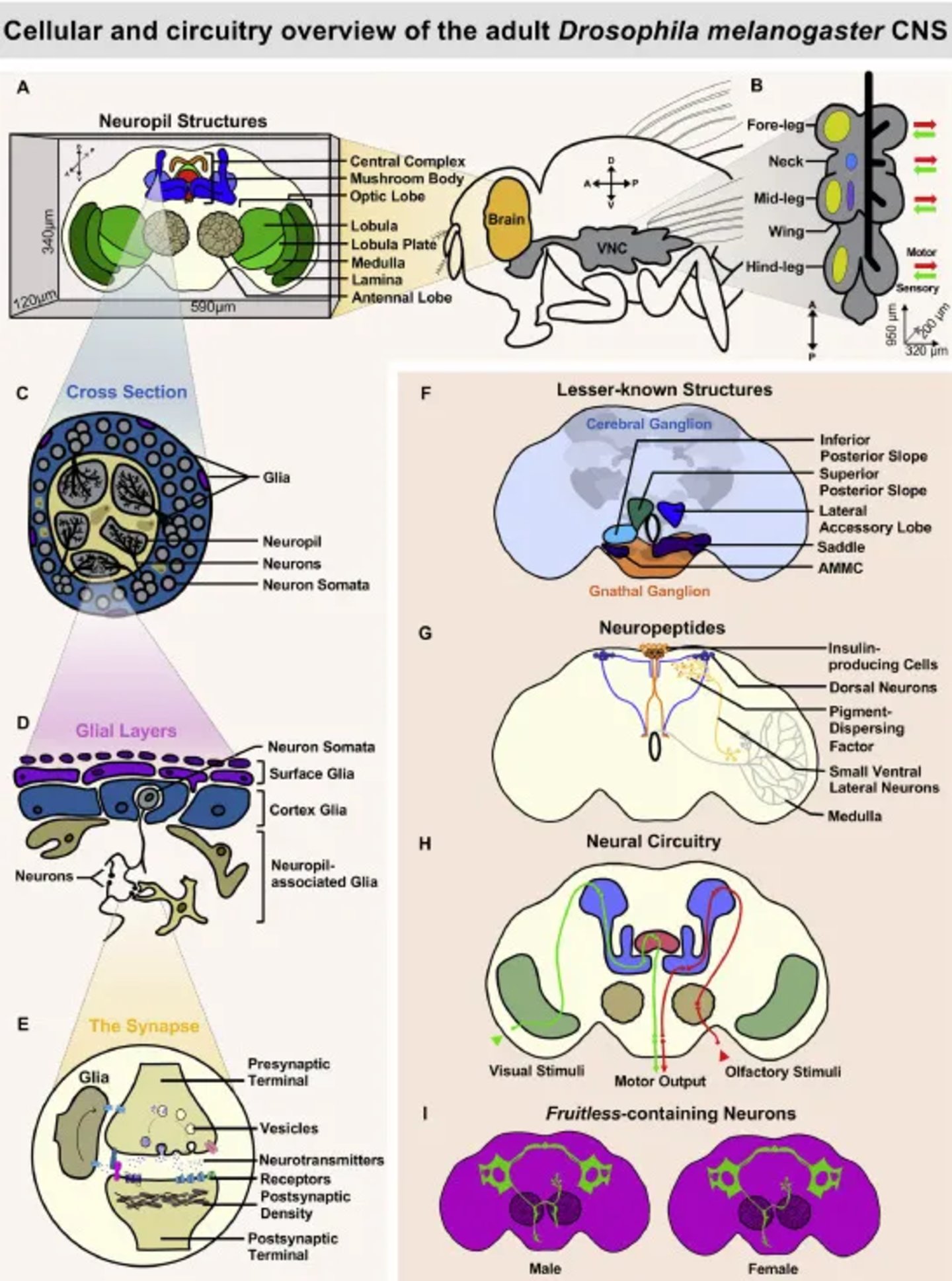

研究人员仅仅是拿到了真实果蝇大脑的12.5万个神经元、5000万个突触的物理连线图 。他们把这张精密的纳米级图纸搬进物理引擎,通上虚拟的电信号。

惊悚的一幕发生了。果蝇在数字世界里自然苏醒。它的行走、梳理毛发,完全是电流穿过特定几何拓扑结构后,自然激发的物理排泄物。

机器自己产生了本能。

令人毛骨悚然的"无码复活"

要理解这件事的恐怖程度,需要先做一个对比。

几年前,DeepMind也做过一只虚拟果蝇。那只果蝇会走路,会跳跃,动作流畅得像真的。但它是被"训练"出来的。通过强化学习,AI在虚拟环境里经历了无数次试错,摔倒、爬起、再摔倒,最终学会了运动控制。它的每一个动作背后,是海量的计算和迭代。可以这么说:它学会了"表演"一只果蝇。

Eon Systems做的是完全不同的事。

他们没有教这只果蝇任何东西。他们用的是2024年发表于《Nature》的FlyWire项目。科学家通过电子显微镜扫描,精准重建了果蝇大脑中约12.5万个神经元和超过5000万个突触连接。这是一张极其精密的神经地图,描述的不是果蝇的行为,是果蝇大脑的物理结构本身。

Drosophila cranial nerves(果蝇颅神经)

Eon把这张图搬进了计算机,用Leaky integrate-and-fire模型模拟神经元的电信号传导方式,再用MuJoCo物理引擎给它一个可以行走的虚拟身体。

然后通上电。没有人告诉它该做什么。它自己开始走路,自己开始清理触角,自己开始朝食物方向移动。这些行为没有被编写,没有被训练,它们从结构里自己涌现出来了。

但这里有一个被大多数报道忽略的细节:FlyWire扫描的只是果蝇的大脑,不是完整的神经系统。大脑的运动信号如何连接到肌肉,这部分数据是缺失的。Eon不得不对这个连接做了"有根据的猜测"。

这个细节说明一件事:即便在数据不完整、必须靠猜的情况下,只要结构的主体部分是对的,行为就会自然涌现。结构里编码的信息量,超过了所有人的预期。

笛卡尔的破产:幽灵就是机器本身

几百年来,人类一直有一个心理防线。

面对任何机器,无论多么精密,我们都可以说:它只是在执行指令,它没有灵魂。笛卡尔把这个防线哲学化了,叫做身心二元论:大脑是硬件,意识是软件,灵魂是住在机器里的幽灵、。

大模型出现之后,这道防线开始动摇,但还没有完全崩塌。ChatGPT再聪明,我们还可以安慰自己:它只是在玩文字接龙的概率游戏,它没有意识,它没有欲望。

赛博果蝇把这道防线炸穿了。

Eon没有给这只果蝇写任何关于"欲望"的代码。没有人在它的程序里输入"你想要食物"这条指令。但它朝食物走去了。这个"想要",不是被编程进去的,是从5000万个突触的空间排列里自然产生的。

这证明了一件事:根本没有幽灵。或者说,幽灵就是这台机器本身的几何形状。

所谓的"本能"和"欲望",不是某种神圣的生命力,不是笛卡尔说的那个住在松果腺里的灵魂。它是神经连线拓扑结构的物理输出。只要你把水管的走向1:1复刻出来,水流的轨迹就是注定的。只要你把神经元的连接方式精确还原,那些被我们称为"生命"的东西就会自己出现。

结构即灵魂。灵魂是一张可以被扫描、被复制、被上传的电路图。

自由意志的物理学死亡

从果蝇到人类,数量级相差70万倍。但这只是数量的差异,不是本质的差异。

1980年代,加州大学教授本杰明·利贝特做了一个让哲学界至今争论不休的实验。他用脑电图监测受试者的大脑活动,同时让他们随机决定在某个时刻弯曲手腕。结果发现:大脑在人意识到自己决定弯腕之前400毫秒,就已经开始产生准备电位。2008年《自然神经科学》用更精确的脑成像技术重做这个实验,把这个时间窗口延长到了7秒。

也就是说,在你"决定"做某件事的7秒之前,你的大脑已经决定了。

你以为你在做选择,其实你只是在事后接收到了大脑已经做出的决定的通知。

把这个和赛博果蝇放在一起看:果蝇"决定"清理触角,是因为第N号神经元的电化学反应达到了阈值,触发了下游的连锁反应,最终产生了那个动作。没有一个"果蝇本人"在某个时刻拍板说"我要清理触角了"。那个决定,在神经元放电的瞬间就已经注定了。

人类"决定"爱上一个人,或者"决定"为了某件事放弃一切,本质上是不是也是860亿个神经元在物理规律下的强制结算?自由意志可能从来不是一种能力,而是一种感觉:大脑在事后给自己的行为贴上的叙事标签。

哲学界62.4%认为意识是真实的独立问题,29.7%认为它根本不存在。果蝇在屏幕上走动,我们知道它的行为是结构的输出,但我们完全不知道它有没有主观体验。一个没有任何内在感受的系统,可以产生完美的行为模拟。

这意味着这个实验同时支持两个完全相反的结论:一是"灵魂就是结构,复刻结构就是复活灵魂";二是"行为可以脱离意识而存在,这只果蝇是一个没有内在体验的空壳"。

我们没有任何工具能区分这两种可能。放到人类身上同样成立。如果有一天人类全脑仿真跑通了,那个数字人在哭,在笑,在说"我很痛",我们没有任何科学方法能验证它是真的在感受,还是只是神经结构的机械输出。

伪造者与复活者的战争

把这件事放回AI行业来看,赛博果蝇代表的是一次真正的范式分裂。

大模型走的是黑盒统计学路线。ChatGPT没有被告知"什么是猫",它只是看了几十亿张图片和文字,统计出了"猫"这个词和哪些像素分布高度相关。它在模仿人类的输出结果,永远不知道自己为什么给出这个答案。这条路线的本质,是用算力去伪造智能的表象。

全脑仿真走的是白盒还原路线。它不模仿输出,它复制结构。ChatGPT是一只会说话的机械鹦鹉,而这只赛博果蝇,就是果蝇本蝇。

这两条路线的差异,在三个方向上会产生完全不同的结果。

可解释性。大模型的决策过程是黑盒,没有人能追溯为什么它给出这个答案。全脑仿真理论上可以追溯到每一个神经元的激活状态,每一个决策都有物理层面的完整溯源。

能效。H100显卡功耗接近700瓦,训练GPT级别的模型需要成千上万张显卡同时运行。人脑20瓦。如果智能真的可以从结构直接涌现,那么未来的计算系统可能根本不需要现在这种规模的算力。

具身智能。机器人现在用的是强化学习加大模型,本质还是黑盒。WBE提供了另一种可能:把生物进化几亿年形成的感知运动能力直接搬进机器,不需要从零训练。

但这里有一个判断需要说清楚:WBE不是要取代大模型。从果蝇到小鼠,神经元数量从12.5万跳到7000万。人脑860亿个神经元,对应的数据量接近1ZB,相当于2025年全球数据总量的六千分之一。仅仅是看清并存储一个人脑,就需要单独建设一套顶级规模的数据中心。

它真正改变的事情是这个:大模型出现之前,AI研究的参照系是图灵测试:机器能不能表现得像人。赛博果蝇之后,AI研究第一次有了一个更深的参照系:生物智能本身。

对着这个参照系看,大模型做到的是什么:它能说话,能写代码,能画画,能在绝大多数认知任务上超越人类。它做不到的是什么:它没有欲望,没有本能,没有从结构里自然涌现的任何东西。它是一个极其精密的伪造者,伪造的是智能的输出,不是智能本身。

大模型是在证明"机器可以像人一样说话"。全脑仿真是在证明"人,原来只是一台机器"。前者只是抢走了我们的工作,后者,动摇了我们之所以为人的根基。

关注塔猴公众号,回复“1”加入专属社群

扫码下载塔猴APP,查看更多干货