Meta连发4款AI芯片,硬刚英伟达、AMD,扎克伯格的阳谋藏不住了

北京时间2026年3月11日,Meta正式公布其自研芯片路线图,放出豪言:计划在2027年底前,部署四代全新自研芯片(MTIA 300、400、450、500)。

这则消息瞬间引爆了整个行业。要知道,就在前不久,Meta才刚刚与英伟达、AMD签下高达数百亿美元的GPU巨额采购订单。

一边是买爆外部算力,另一边却在自研芯片,甚至扬言“半年一更”。

扎克伯格为何要一边“爆买”一边“自造”?Meta到底在布一个怎样的局?塔猴翻看了Meta官方博客及外媒专访,这才发现,扎克伯格的阳谋已经藏不住了。

01. 一边“爆买”英伟达,一边“造备胎”

“鸡蛋不能放在同一个篮子里”,在AI时代,这个篮子的名字叫作英伟达。

回顾过去两年的行业大盘,这其实是一个老生常谈的问题:算力焦虑。

英伟达的Blackwell/Rubin系列和AMD的MI系列GPU虽然性能逆天,但价格极其昂贵,动辄数万美金一块,且交货周期漫长,可谓“一卡难求”。对于拥有超30亿全球月活用户的Meta来说,如果所有的AI生成和推荐任务都跑在商用GPU上,哪怕再有钱,也会被高昂的电费和硬件折旧费拖垮。

这次最大的变化在于,Meta坚决执行“双轨并行”的战略。

在外部,Meta继续稳坐全球最大GPU买家的王座。他们不仅囤积了数百万块NVIDIA GPU,近期甚至与AMD签下了高达6吉瓦(GW)算力的长期采购协议,确保在大模型基础训练(如Llama系列)上有绝对的压制力。

而在内部,Meta正投入数十亿美元,收购了Rivos等初创团队,扩充自研芯片大军,誓要打造属于自己的硬件帝国。

为什么一边买还要一边造?这是对“通用”与“专用”的重新思考。

通用的GPU它什么都能干,但代价是极溢价和功耗。而Meta自研的MTIA芯片,剔除了通用芯片中那些对Meta没用的冗余功能,专门针对Instagram/Facebook的信息流排序推荐,以及生成式AI的日常推理。

这是非常聪明的算账方式:尖端交给英伟达,而日常高频的、需要海量并发的简单提问,交给自家便宜的MTIA。

正如Meta工程副总裁Yee Jiun Song在接受采访时所说:“这不仅能让我们在数据中心榨取更高的性价比,更重要的是提供了硅片供应的多样性,在某种程度上使我们免受价格波动的影响。”

说白了,这是一场防御性的“备胎战略”。可以对冲供应商涨价或断供的风险,将命运握在自己手中。

02. 半年一迭代,四代芯片拆解

如果说双轨制是Meta的防手战略,那么刚刚公布的芯片路线图,则反击战略。

通常来说,传统芯片巨头(哪怕是英伟达)的架构迭代周期也是按“年”计算,但Meta计划把这个节奏拉到的“6个月发布一代”。

“天下武功,唯快不破”,AI的演进速度太快了,Meta只有拼命,才能不被最新的算法淘汰了。硬件,必须追着软件跑。

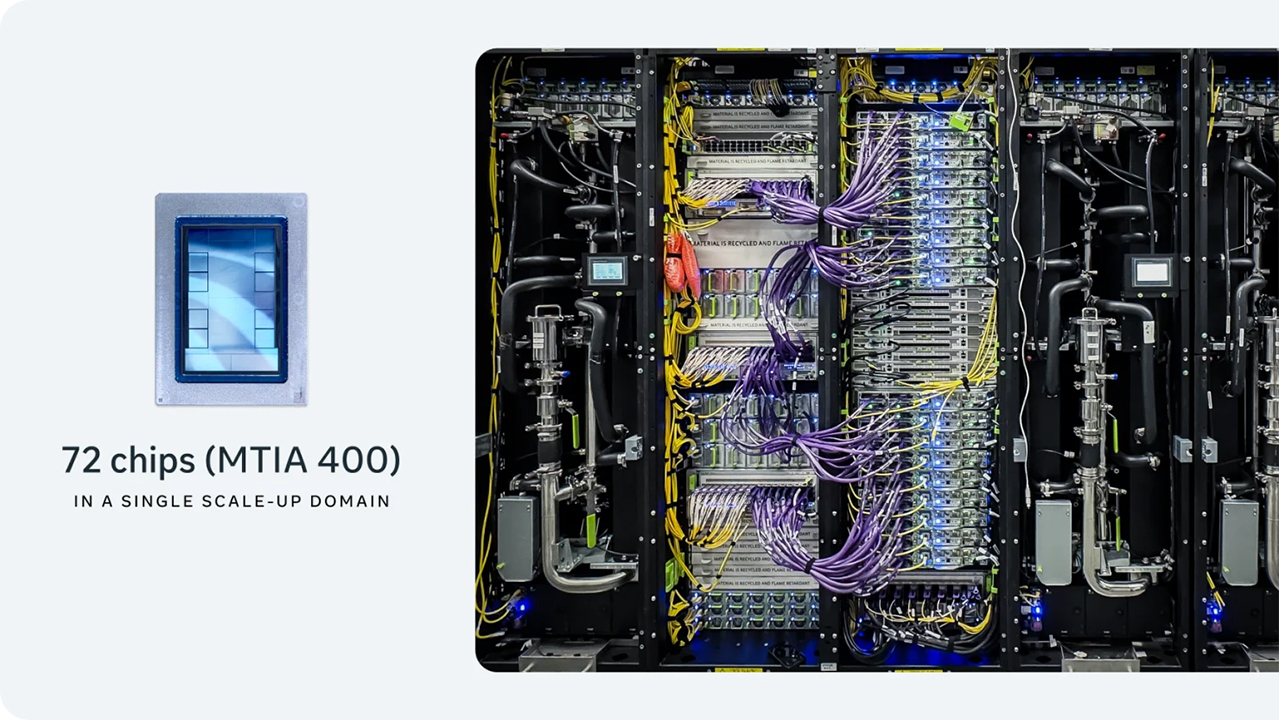

Meta MTIA 400 芯片

让我们来看看扎克伯格的计划:

MTIA 300(已落地): 这是已经投入生产环境的现役老兵,它目前主要在后台干“苦力活”,负责Meta核心的排名和推荐模型的训练。你刷短视频时觉得越刷越上头,背后就有它的功劳。

MTIA 400(代号Iris,即将发布): 目前实验室测试已全面完成,正火速推向数据中心。一个标准机架将塞进72块MTIA 400芯片,它专门被优化用来加速AI推理任务,2026年内点亮。

MTIA 450(代号Arke,2027年初): 这是为生成式AI推理量身定制的进阶版,Meta官方透露,由于生成式AI极度吃内存带宽,MTIA 450的HBM(高带宽内存)带宽比上一代400直接翻了一倍!

MTIA 500(代号Astrid,2027年底): 这是目前路线图上的王者,在450的基础上,它的HBM带宽再次提升50%。

如果把这四代放在一起看,数据极其震撼:从300到500,整体HBM内存带宽飙升了约4.5倍,而核心的计算算力更是呈指数级提升了约25倍!

如果过去让AI生成一段高清视频,服务器可能需要转圈苦算十几秒;而在MTIA 500的加持下,可能只需眨眼间的功夫,且单次生成的电费成本直线下降。

为什么Meta能做到半年一迭代?只因其模块化设计。

Meta联合了通信芯片巨头博通进行研发,并交由台积电代工。他们没有每一代都把芯片推倒重来,而是在相同的机箱、机架和网络基础设施上,直接替换最新的计算或内存模块,实现平替化迭代。

这种极度务实的战略,让Meta在硬件赛道上跑出了软件开发才有的超高速度。

03. Meta与云服务商的不同路线

自主造芯好处这么多,那其他企业怎么做?其实Meta并不是独行侠,放眼望去,美国各大巨头都在疯狂内卷。

谷歌早在2015年就拿出了TPU;亚马逊AWS在2018年就发布了定制芯片;微软也掏出了自研的Maia芯片。

但是,Meta与这些巨头有着一条不同的路线。

谷歌、亚马逊和微软的芯片,是为了放到自家的云计算平台上,然后出租卖给B端客户赚钱。

而Meta是“肥水不流外人田”,完全不对外售卖,也不提供云服务,只支撑Meta自家应用矩阵里那几十亿用户的日常消耗,进而卖出更多、更精准的广告。这是一种完全的内循环。

搭载72颗MTIA 400芯片的机架

但计划得再好,也得有米下锅。随着MTIA 450和500性能的提升,Meta正面临着HBM(高带宽内存)产能荒。

生成式AI的算力瓶颈,往往不在计算核心,而在内存传输速度。这就好比高速公路,如果内存这条路不够宽,跑车也只能在收费站堵着。

目前,全球HBM的命脉几乎被韩国的SK海力士、三星以及美国美光这三家存储巨头垄断。

Meta工程副总裁Song在采访中表示:“我们绝对担心HBM的供应。”但他紧接着强调,Meta已经通过多方长协订单,锁定了未来扩张所需的内存产能。

在看不见的供应链战场,Meta不仅要和英伟达抢台积电的先进封装产能,还要和全球同行去抢夺极度稀缺的HBM颗粒。

04. 千亿美元的基建狂潮

再牛的芯片,再宏大的路线图,如果没有庞大的数据中心来承载,也不过是镜花水月。Meta的算力阳谋,最终还是落地在美国本土轰轰烈烈的基建狂潮上。

为了容纳这些AI芯片,Meta正在全美各地大兴土木。

据多家外媒披露,Meta正在路易斯安那州、俄亥俄州和印第安纳州疯狂建设超大型数据中心。更夸张的是,在OpenAI和甲骨文因为电力等问题放弃了得克萨斯州庞大的“星际之门”数据中心扩建计划后,Meta火速入局,计划租赁该场地。

路易斯安那州在建数据中心

Meta在全球已建和规划的30个数据中心里,有多达26个位于美国本土。同时,负责MTIA硅片研发的数百名核心工程师团队,也绝大多数驻扎在美国。

这其中包含了深远的地缘政治与能源战略考量。AI的尽头是电力,谁能搞定几百兆瓦甚至吉瓦级的稳定供电和液冷设施,谁才能让机柜里的MTIA芯片全速运转。

通常情况下,硬件开发需要提前两年去预测未来的工作负载,但AI模型可能几个月甚至几天就会发生翻天覆地的变化。“用最新的基建,跑最新的模型”,这是Meta的解法。

结语

所有的技术起点,最终都要落地到现实世界,Meta的这份路线图,就是用真金白银去保住大模型基础训练的领先地位。

先用数以百亿资金买空市面上的英伟达和AMD GPU,再用半年一更的自研MTIA芯片守住成本,这就是扎克伯格的阳谋。

(微信公众号:Tahou_2025)扫码下载塔猴APP,查看更多干货