谷歌深夜大招!机器人看懂指令,效率暴涨 300%

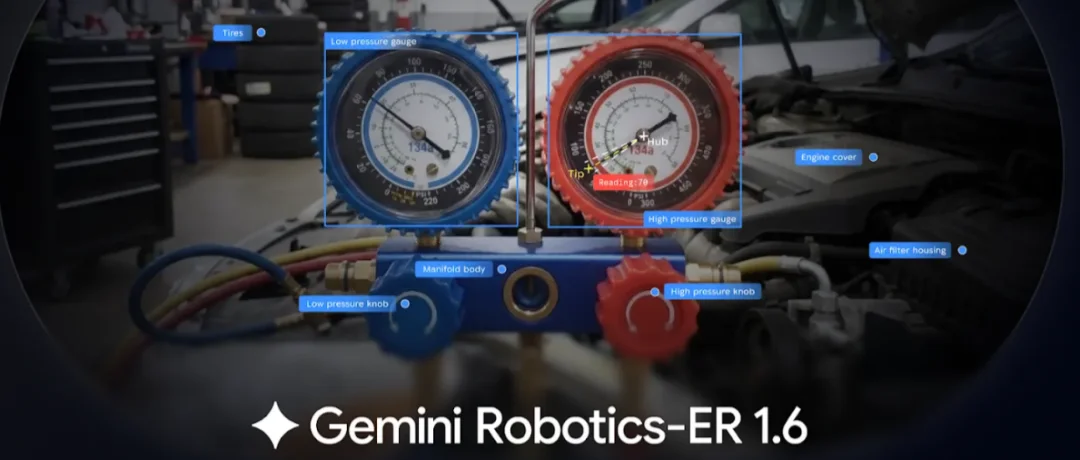

谷歌深夜放大招!机器人终于学会看表干活啦,成功率直接飙升300%哦,昨天深夜我刷到消息的时候还真愣了一下,谷歌突然就把Gemini Robotics-ER 1.6扔出来了。他们这次跟波士顿动力居然玩真的,给机器人装了个能读仪表的脑子呀,去年9月1.5版本才刚出,半年多点就迭代到1.6,谷歌这速度我说句实话简直不要太猛了。

AI终于学会了看细节

简单一点说呢,这个模型就是给机器人当高层大脑用的,它能直接调用Google Search、视觉动作模型,还支持第三方功能,帮机器人自己搞定那些机器人搞定不了的,最让我惊喜的升级就是现在机器人能看懂工厂里那些老掉牙的压力表、液位观察窗啥的,要是以前机器人估计直接傻眼,现在它可以精确读出指针位置、液位高低,甚至连单位和小数位都搞得清楚,这也太有东西了。

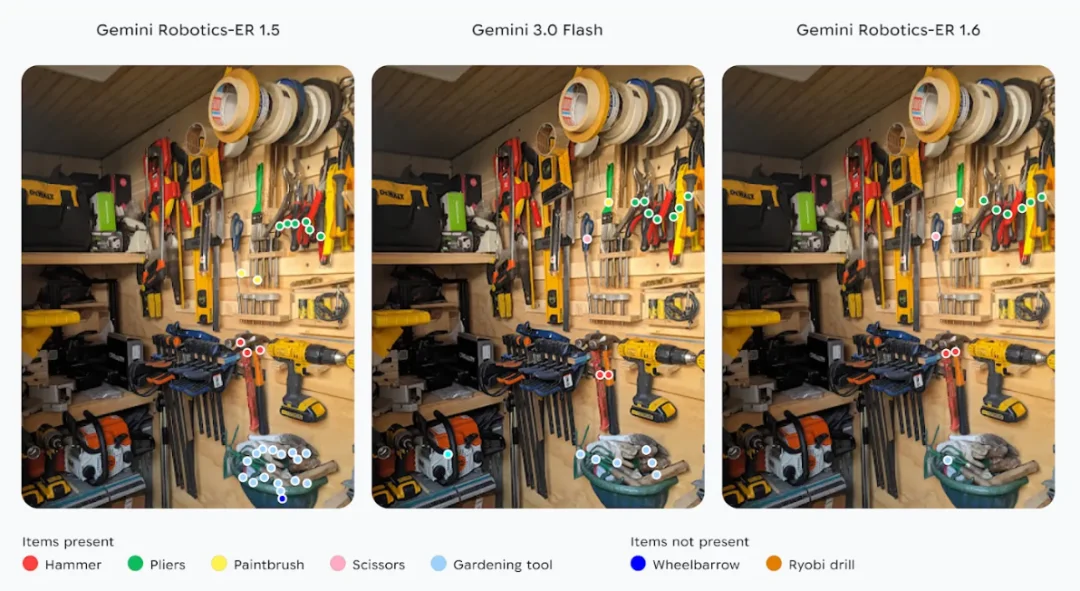

实际效果有多离谱呢?谷歌放出来的数据里用了Agentic Vision技术后,仪表读数任务成功率从1.5版的23%直接干到93%,差不多翻了四倍。我看完数据都觉得有点不真实这进步也太快了。点位定位和计数这些基本功也强了不少。以前1.5版老是漏东西乱指不存在的一些,或者把锤子和油漆刷数量搞混。现在1.6版稳多了,它能准确认出图里有2把锤子、1把剪刀、6把钳子,还知道哪些东西其实压根不存在不会瞎猜。

多视角融合

多视角推理也明显好多了,机器人现在能把好几个摄像头画面综合起来看,就算东西在动或者被挡着,也能判断任务到底做完没有。比如把蓝色笔放进黑色笔筒这种小事,它自己就能确认,而不是傻乎乎一直重复动作。

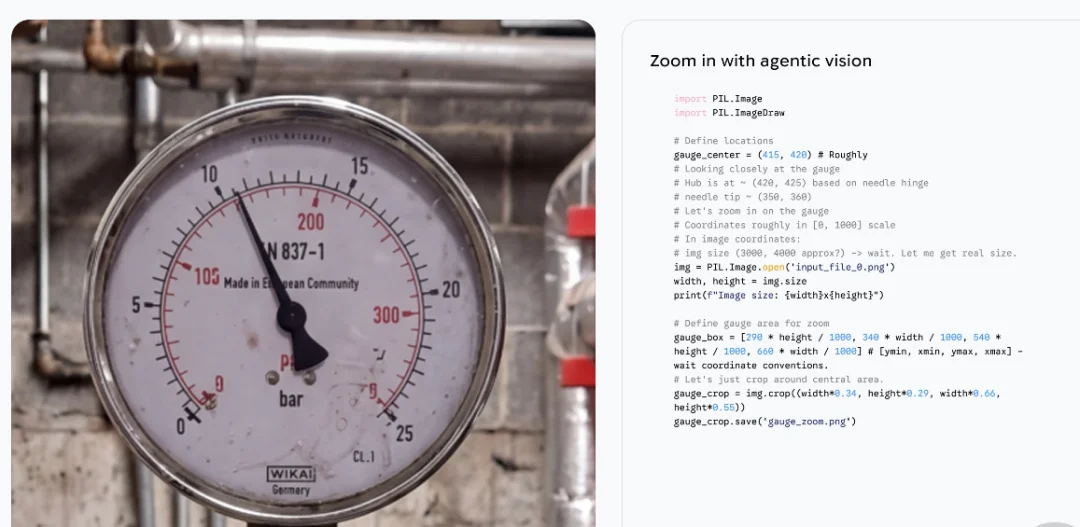

工厂里这功能最实用。到处都是温度计、压力表、化学液位窗,人工巡检又累又比较危险。我想象了一下,波士顿动力的Spot四足机器人装上这个模型后,就能自己走过去读数巡检,全程基本不用人盯着,感觉工业现场一下子就轻松了很多,模型读仪表可不是简单扫一眼OCR,它会先放大图像看细节,再用点位标注加代码执行算比例,最后结合常识判断读数到底啥意思,整个过程像人脑在想问题特别的灵活。

安全这块谷歌也是狠狠把握住的,1.6版在物理约束上细致多,知道哪些东西能抓、哪些不能碰(比如液体或者超重物体),还能从真实事故报告里学着识别潜在危险。文本场景识别准确率比之前高6%,视频场景高10%,至少在别把自己搞坏这件事上靠谱了不知道多少。开发者现在就能直接通过Gemini API和Google AI Studio调用,挺方便的。

产业落地

说实话这次升级让我感觉机器人离真正走进工厂又近了一大步。以前总觉得具身智能还在实验室里炫技,现在连工业仪表这种接地气的难题都开始攻克了。还有安全成本可靠性这些老问题还是得慢慢解决的,谷歌这波至少把让机器人更聪明地看懂世界往前推了一截。你觉得以后机器人会不会真把工厂巡检全包了?欢迎评论区随便聊聊你的看法。