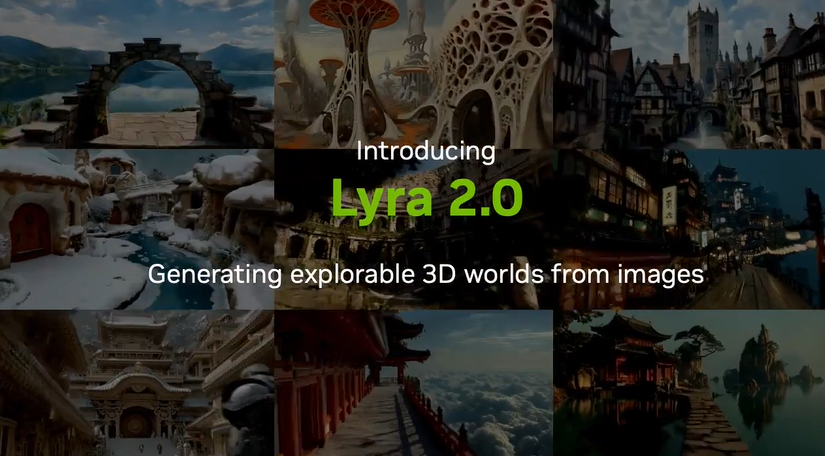

NVIDIA Lyra 2.0从2D到可探索世界

NVIDIA刚刚开源了Lyra 2.0,这是一个真正的生产力工具。过去一年里AI视频生成最大的软肋就是长程一致性,相机一开始动背景细节就变了,走了两步前面的路就断了,这被行业内称为是空间遗忘和时间漂移。Lyra 2.0的核心逻辑是为AI引入了空间记忆机制。不但可以生成一张图,还可以在后台维护一套3D几何映射。

核心范式

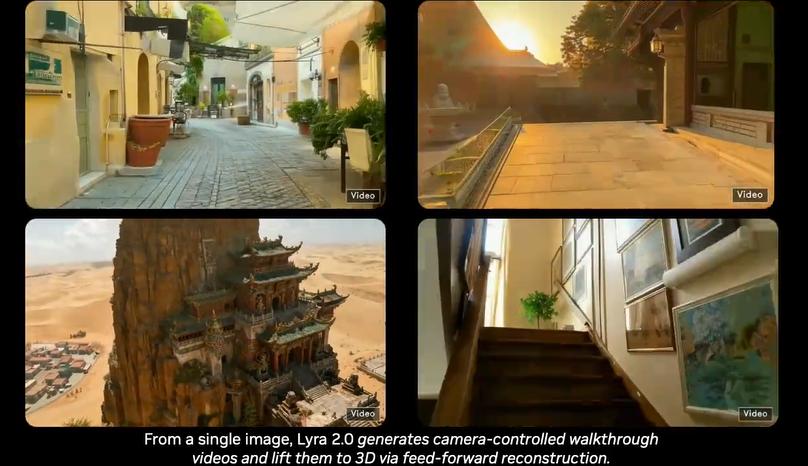

AI视频长时程生成的难题是模型丢失了空间坐标的参照系。当通过控制相机移动来观察场景时,模型无法计算出深度的连续性,就会出现物体位置偏移或者材质闪烁。Lyra 2.0并不是靠堆叠参数来解决漂移问题的,而是引入了3D几何信息路由。

在后台为每一帧维护了一个3D坐标系。相机移动时,模型通过几何计算来路由历史信息,确保物体在空间中的相对位置不变,避免了误差随时间累积。外观生成依然由生成式先验负责,这说明在探索3D世界看到的墙面、物体细节依然保持了极高的视觉真实感。

传统模型训练时一旦生成出现退化,错误就会在长序列中被不断放大。Lyra 2.0的核心在于自增强训练策略。训练过程中模型会不断接触自己生成的、质量下降的样本,会被强制训练去识别错误并主动修正。

工业应用

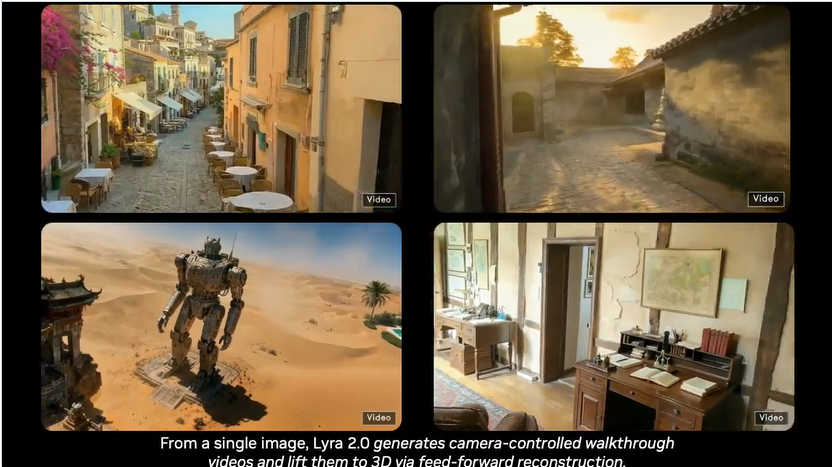

工具再强如果不能集成到Unity、Unreal或Isaac Sim中,那它也只是演示用的Demo。Lyra 2.0的目标就是直接产出可用的3D资产。机器人的具身智能训练是极其依赖于仿真环境。是需要成千上万种不同的室内场景,如果全靠人去建模,成本高到无法想象。Lyra 2.0可以直接从简单的场景照片生成几十米长的探索轨迹,并直接导出为Isaac Sim兼容的格式,这相当于给了机器人一个自助训练场。

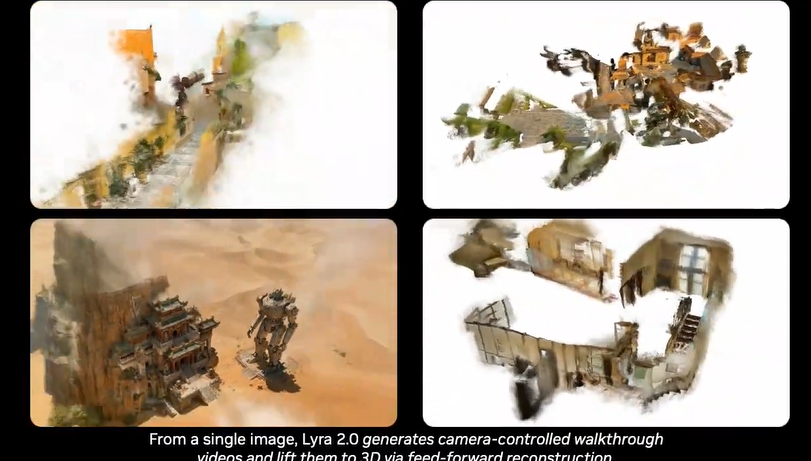

以前一个3D场景的搭建需要数周时间,现在可以通过单张图片快速构建。开发者可以通过浏览器定义相机移动轨迹,模型自回归生成视频。最后将视频提升为点云、Gaussian(高斯)或网格资产,直接导入引擎。

未来趋势

Lyra 2.0基于Wan-14B扩散模型,展现出了一套成熟的高性能模型组合范式。

在视频生成领域14B(140亿参数)是一个黄金规模。它既能承载复杂的语义认知,又能保持足够的推理速度,满足工业级落地的实时性需求。一味追求千亿级参数会导致显存爆炸是无法在本地环境进行实时的3D几何计算。

Lyra 2.0的本质是语义映射,它不依赖于简单的像素叠加而是将图片信息映射到隐空间。它能够直接将二维图片转化为三维空间语义,只需要语义映射准确生成的3D世界就不会在走动时出现空间崩塌,因为模型脑子里存储的是物理逻辑,而非单纯的图像色块。Lyra 2.0的开源将3D重建这项过去需要高门槛专业技术的工作,简化为了一个标准的生成任务。