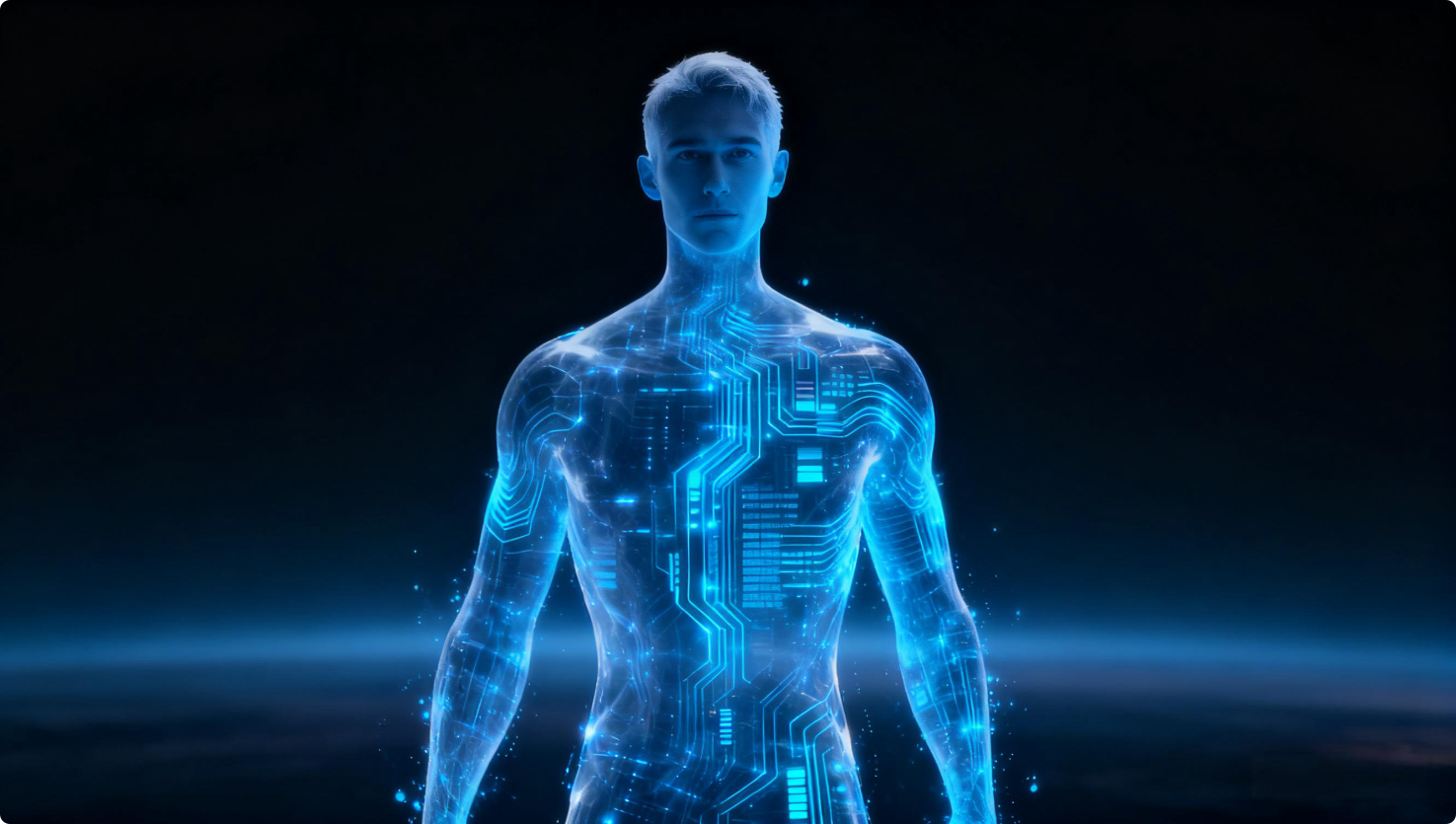

AI如何给数字人“注入灵魂”,让木偶秒变影帝的?

你是否也曾盯着屏幕里那些栩栩如生的数字角色发呆——他们的每一道皱纹、每一束肌肉的牵动,甚至眼神里稍纵即逝的情绪,到底是怎么“造”出来的?

过去,这背后是建模师和动画师们数不尽的深夜、鼠标与数位板之间的反复纠缠。而今天,AI悄然进场,它不像一个冰冷的工具,更像一位精通解剖与表演的“数字巫师”,正默默改写角色创造的法则。

从“捏泥巴”到“基因编辑”,建模这事被AI彻底颠覆了

传统3D角色建模,简直是一场体力与耐心的终极考验:原画、粗模、雕刻、拓扑、展UV、贴图、材质……流程长得让人绝望。一个好莱坞级别的数字角色,耗费一支资深团队数月时间是家常便饭。但AI来了,它不和你一步步来,直接玩起了“数字基因编辑”。

- 告别手动调参,用“数据”捏脸

现在行业里像 Reallusion Character Creator 这样的工具,内核已经完全不同。你可以把它看作一个“超级捏脸系统”,而它的背后是吞下了海量真实人脸数据,例如骨骼、肌肉、皮肤纹理,甚至岁月留下的痕迹。

当你输入“一位饱经风霜的50岁渔民”,AI不是凭空想象。它会从解剖学的逻辑出发,自动组合出符合年龄的骨骼结构、松弛的皮肤状态,就连眼角的鱼尾纹和脸颊上那些风吹日晒的斑迹,都来得迅速而自然。曾经手工雕刻几小时才能表现出来的皮肤质感,AI几秒就能生成,并且因为源于真实数据,那种“真实感”很难用手工复刻。

- 一键披上“艺术外衣”

除了写实,风格化角色也更自由了。类似 DeepArt 这种基于风格迁移的技术,虽然大众用它来把照片变梵高画,但在影视前期,它成了贴图师的“外挂”。

假设美术指导要求角色具备某种油画笔触质感。以前,贴图师得一笔一笔模拟,现在只需把基础贴图丢给AI,指定一种风格,它就能生成整体统一、笔触自然的纹理。效率是一方面,更重要的是,AI像个绝对服从的风格执行者,能保证成百上千张贴图风格一致,避免团队合作中的风格漂移。

当AI让任何人都能“驱动”角色,动捕不再“烧钱”

模型建好了,怎么让它活起来?

传统光学动捕,演员穿着紧身衣贴满Mark点,在造价不菲的棚里表演——贵、麻烦、门槛高。而AI的思路很直接,让你零成本动起来。

- 随手一段视频,就是动捕数据

如今像DeepMotion这样的工具,正在推动“无标记点动作捕捉”普及。想象一下,你想让角色跳段街舞,不用请动捕演员,也不用专业摄影棚,只需要找一段真人跳舞的视频(哪怕是手机拍的),扔给DeepMotion。它会像一位资深动画师逐帧分析,通过计算机视觉识别关节位置、身体扭转、重心变化,然后把2D视频信息“翻译”成3D骨骼动画数据。

这种从真实世界“学来”的动作,自带物理惯性般的流畅过渡,远比新手手动K帧自然得多,正好填补了“高端动捕”和“手动调动画”之间的空白。

- 微表情,AI比你更懂“像人”

角色动起来还不够,还得动得像个人。在CGI领域,有个著名的“恐怖谷理论”,当机器人或动画角色做得非常接近真人,但又有一点点不像时,人们会感到极其惊悚。现在,而AI正在帮我们跨过它。

AI通过学习大量真人表情数据,知道真笑时眼角会皱起,假笑只有嘴角动。于是,数字角色的表情不再是简单的参数滑动,而是牵一发而动全身的肌肉群协同。那种细腻的微表情,终于让虚拟角色有了“人味”。

结语

看到这里,可能有人会问:建模师、动画师是不是要失业了?我的感受是重复性高、劳动密集的那部分工作,确实会被AI接替,但真正需要审美、导演思维和人性理解的工作,反而会更被重视。

AI能快速生成毛孔细节,能把视频转成动画基础,但它不懂角色眼神里该藏多少故事,也不明白某个剧情转折点,动作应该是迟疑还是决绝。

像 DeepMotion、Character Creator 这类工具,本质上提升的是创作效率和质量的下限。而作品的上限,例如情感、叙事、艺术风格,依然牢牢握在人类创作者手中。

未来的影视行业,或许不再拼谁更能熬夜调参数,而是拼谁更善于驾驭AI,把脑海中的想象,更精准、更流畅地实现出来。