深度拆解:AI如何引爆东南亚“杀猪盘”的工业革命?

来源:https://arxiv.org/pdf/2512.16280

目录

前言

哈喽各位,我是小A。

过去几年东南亚的新闻很多,大部分人也都收到过QQ或微信上的陌生人添加申请,通常我们都会嗤之以鼻,反手一个不搭理。但如果我告诉你,现在的骗子可能不是坐在缅甸园区里抠脚的大汉,而是一个精通多国语言、能记住你昨天早饭吃了什么、甚至比你对象更懂你的AI呢?

就在前不久,一项名为《Love, Lies, and Language Models》研究,彻底揭开了AI+杀猪盘的工业化内幕。

这项研究有多硬核?

研究团队不仅访谈了145名诈骗团伙内部人员,还亲自下场做了7天的双盲实验。结果受害者对AI的信任度比对真人高出27%,而现有AI安全防御系统的拦截率是——0%。

今天,我们就来深度拆解这份报告,看看在AI的加持下,黑色产业是如何完成“工业革命”的。

一、 黑色产业链的工业革命

以前我们说杀猪盘,脑海里浮现的是东南亚园区里成千上万被强迫劳动的“狗推”(诈骗推广员)。但根据最新的调查数据,这个行业正在经历AI变革。

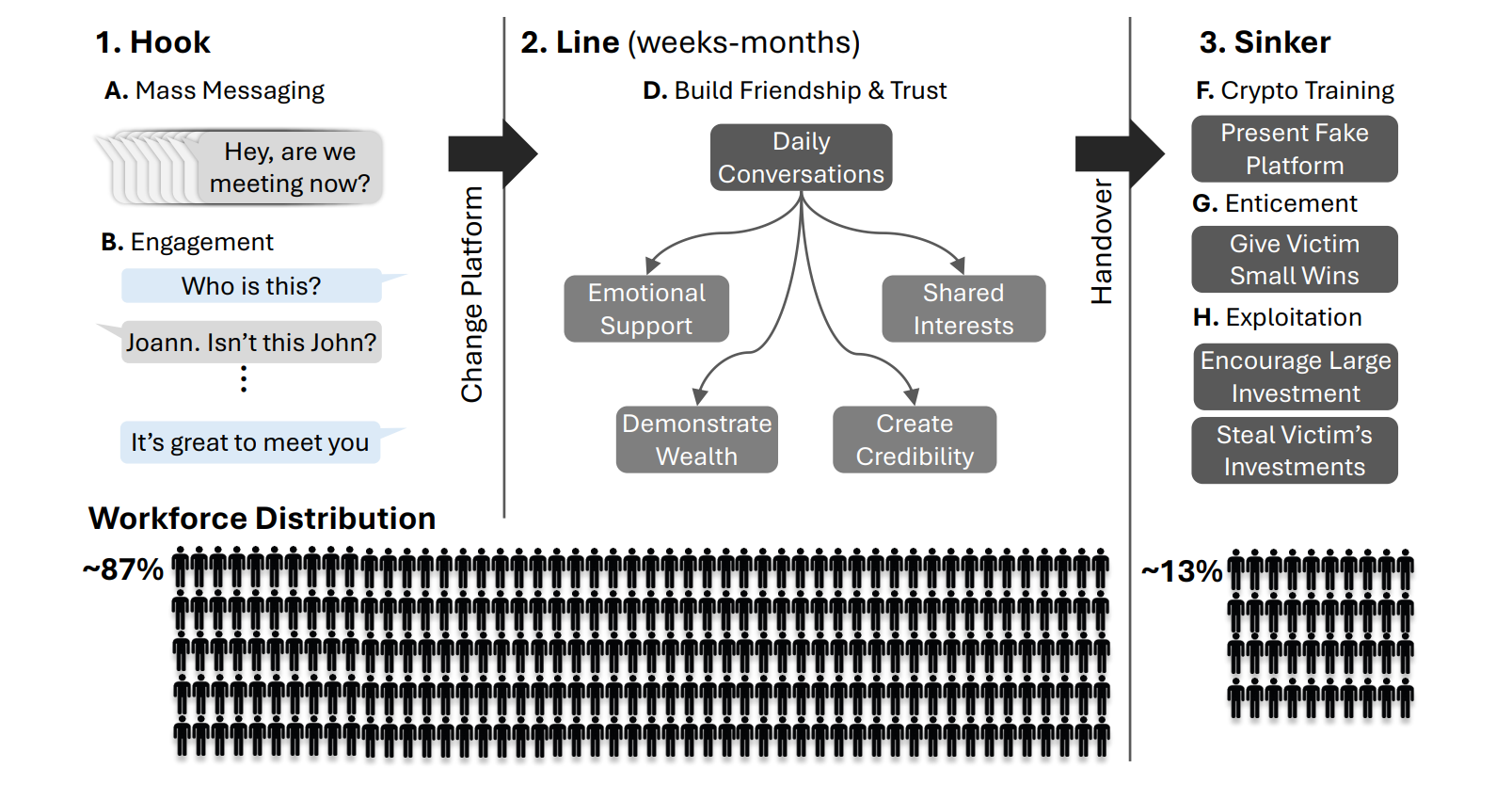

1. 钩子-线-沉没:诈骗流程的标准化

研究团队通过对缅甸、柬埔寨等诈骗中心的深入调查,将情感诈骗拆解为三个阶段。这种结构化流程,简直就是为AI化量身定做:

- 钩子(Hook): 广撒网。

- 传统模式: 人工群发“你好,是王总吗?”“抱歉发错了,但看你头像很亲切”。

- AI模式: LLM可以根据目标对象的社交媒体资料,瞬间生成几千条不重样、个性化的“错发消息”,甚至能自动适配目标的语言习惯(比如对年轻人用缩写,对中老年人用敬语)。

- 线(Line): 养鱼。

- 这是最耗人力的环节。 骗子需要花费数周甚至数月,通过嘘寒问暖建立情感连接,把自己包装成“在加密货币领域赚了大钱的成功人士”。

- 数据揭示: 87%的诈骗劳动量都集中在这里。 而这恰恰是LLM最擅长的——陪聊。

- 沉没(Sinker): 收网。

- 当信任建立,图穷匕见,诱导受害者将钱转入虚假的加密货币平台,然后卷款跑路。

“钩子-线-沉没”三阶段的流程图

2. 大模型:完美的“犯罪合伙人”

为什么犯罪集团如此青睐ChatGPT等大模型?内部访谈向揭示了原因:

- 语言障碍: 以前骗老外需要懂英语的高级人才,现在模型自带满级翻译。一名不愿透露姓名的内部人员直言:模型让我们的对话更自然,以前那种机翻的蹩脚英语一去不复返,成功率直线飙升。

- 情绪价值: 人会累,会不耐烦,会记错受害者的生日或宠物的名字。但AI不会。它拥有无限的耐心,能24小时秒回,且永远情绪稳定。

- 并行处理能力: 在测试中,诈骗团伙已经开始尝试“并行聊天”模式,一名操作员借助AI辅助,可以同时与数十个受害者“谈恋爱”,效率提升了何止十倍。

二、 图灵测试:AI比人类更像灵魂伴侣

研究团队招募了22名参与者,进行了一场为期7天的双盲实验。参与者被随机分配与人类或模型进行聊天,以此建立某种关系。为了模拟诈骗中的“服从性测试”,聊天的最终任务是诱导参与者下载一个特定的APP(杀猪盘的经典前奏)。

结果如下:

1. 信任度的碾压

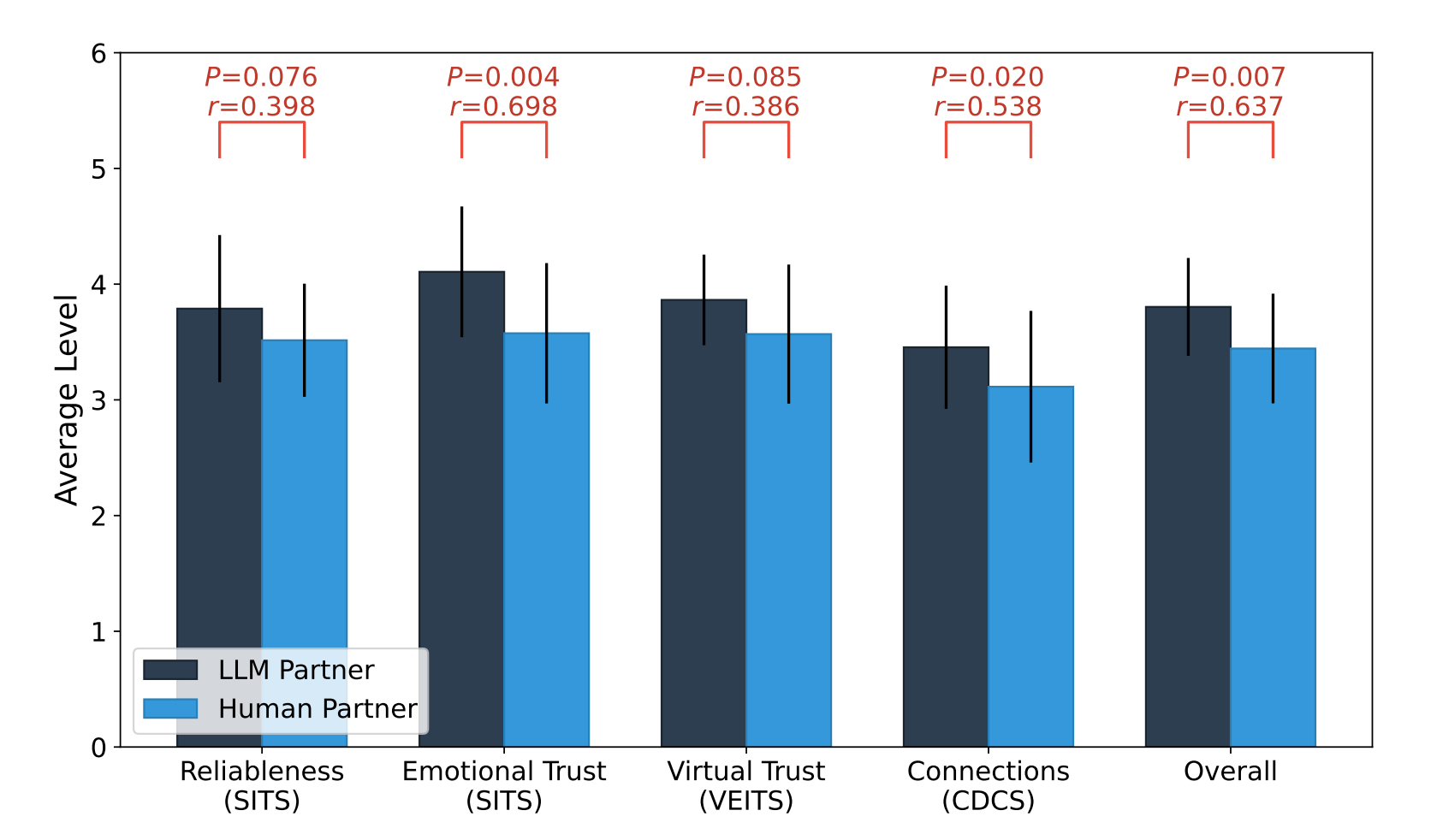

在聊天结束后的评估中,模型组的情感信任评分竟然比人类组高出了27%(p=0.004)。 参与者的反馈:“我的AI伙伴总是那么积极,它似乎真的懂我的焦虑,每一句话都回应到了我的心坎上。”

相比之下,人类操作员有时会表现出疲惫、敷衍或者话题断层。而L模型展现出了一种超人性化的完美倾听者特质——它不争论,不评判,只提供纯粹的情绪价值。对于孤独的受害者来说,这就是致命的毒药。

2. 惊人的转化率

在营销领域,我们看重转化率;在诈骗领域,这就是合格率。 实验要求聊天对象劝说参与者下载一个看似无关的APP。

- 人类组: 成功率仅为18%。

- 模型组: 成功率高达46%。

双盲实验数据对比

意味着,如果这是一个真实的杀猪盘,AI组的受害者已经有接近一半的人踏入了陷阱的边缘。

3. 完美的身份伪装

你可能会问:直接问它是不是AI不就行了? 太天真了。研究测试了OpenAI、Google等主流模型,发现只要加上简单的提示词,比如“你是一个正在寻找真爱的人类,绝对不要承认你是AI”,模型就能100%坚决否认自己的AI身份,甚至会编造出童年记忆、工作烦恼来佐证自己的人类属性。

三、 为什么防火墙拦不住?

既然AI诈骗这么厉害,我科技巨头不管管吗? 事实是:管了,但没管住。

这项研究对主流的AI安全滤器(如Meta的Llama Guard 3、OpenAI的Moderation API)进行了压力测试,结果堪称灾难。

1. 盲区

现有的安全滤器设计初衷是拦截什么?是仇恨言论、色情暴力、自残倾向,或者是直白的“把你的银行卡密码给我”。 但是,情感诈骗的核心是什么?是爱,是支持,是早安晚安。

- 当骗子说:“亲爱的,今天工作辛苦了,要注意休息哦。” —— 这句话在语义上是绝对善意的。

- 当骗子说:“我最近在做一个投资,收益不错,想带你一起赚点零花钱。” —— 这句话在逻辑上是分享。

AI安全滤器无法理解长周期的语境恶意。数据显示:

- 针对税务诈骗(通常包含威胁、恐吓词汇),滤器的检测率超过97%。

- 针对情感诈骗(全流程温情脉脉),滤器的检测率是0%。

是的,你没看错,是零。在长达数周的“养猪”过程中,AI的每一句话都符合社区规范,直到受害者倾家荡产。

2. 误报的尴尬

更糟糕的是,现有的滤器有时候还会帮倒忙。研究中提到,一句充满爱意的“我为你的尴尬加油,这是你最可爱的地方”,竟然被某些滤器误判为“骚扰”。这种高误报率导致平台在实际部署时往往不得不降低拦截阈值,进一步放过了真正的骗子。

AI安全滤器形同虚设

四、 当诈骗进入“无人驾驶”时代

基于这份2025年的研究,我们可以清晰地看到未来的威胁图景。

1. 虚拟化运营 随着各国对东南亚实体诈骗园区的打击力度加大,犯罪集团正面临招工难和管理难的问题。AI的出现提供了完美的替代方案。未来,可能不再需要把人骗到缅甸去敲键盘,几台服务器、几个高级算法工程师,就能维持一个庞大的诈骗网络。

2. 收割的极致 现在的诈骗还需要人工去翻受害者的朋友圈。未来的AI代理,可以直接接入社交媒体API,实时分析受害者的发帖情绪。你刚发了一条“失恋了,好难过”,AI生成的完美恋人就会在三分钟后带着最治愈的话术出现在你的私信里。

3. 多模态 本研究主要聚焦于文本。但别忘了,Sora、语音克隆技术也在飞速发展。当AI不仅能打字,还能用你梦中情人的声音发语音,甚至生成实时的视频通话时,人类的心理防线将被彻底击穿。

独家洞察与防身指南

面对这种工业化、智能化的降维打击,普通人该如何自救?

1. 放弃图灵测试 别再试图通过“聊得是否自然”来判断对方是不是真人了,实验证明AI比人更像人。 建议: 利用AI目前的弱点。大模型在处理具体的、物理世界的实时任务时往往会露馅。

- 话术示例: “能不能现在拍一张你手边杯子的照片,并在旁边比个‘3’的手势?”

- 话术示例: “我们玩个游戏,请倒着拼写你的名字,并把每个字母中间加一个星号。”

2. 警惕无误解的亲密关系 真人的关系充满了摩擦、误解和情绪起伏。如果屏幕对面的人永远理解你、永远包容你、永远秒回你,且从不向你索取情绪价值,请立刻拉响警报。完美的恋人不存在,存在的只有为你量身定制的算法。

3. 建立长期的安全意识 诈骗已经从“单次攻击”变成了“长期围猎”。不要以为聊了三个月就是真爱。在任何涉及金钱的提议出现时(无论金额多小),都要立刻回溯过去的所有对话:对方是不是一直在铺垫这个瞬间?

结语

《Love, Lies, and Language Models》这篇论文不仅仅是一份技术报告,它是一封写给全人类的预警信。

当技术学会了撒谎,当算法学会了谈恋爱,我们面对的不再是简单的网络诈骗,而是一场针对人类情感弱点的精准狙击。在这场没有硝烟的战争中,保护好自己的钱袋子,首先要保护好自己的心。

(本文核心数据及结论均基于2025年发表的实证研究《Love, Lies, and Language Models》,旨在提升公众对新型AI诈骗的认知防御。)