2026零售业困局:为什么AI算准了每一道题,CEO却输掉了整场考试?

如果你翻开 2025 年各大零售巨头的财报,“AI”无疑是那个最昂贵、也最令人爱恨交织的注脚。

在董事会的演示文稿里,这是一场辉煌的胜利。根据麦肯锡的最新行业报告,全球 88% 的零售组织已经宣称跳出了试点阶段(Pilot Purgatory),将 AI 深度植入从采购到售后的日常运营。

但在这些繁荣的数字看板与飙升的股价背后,行业内部却弥漫着一种无法言说的疲惫感:效率的提速,并没有带来决策的解放,成千上万的高薪人类经理,正在给 AI“擦屁股”。

这就构成了零售业最大的“自动化悖论”:算力越强,人类不仅没有被解放,反而被困在了“人肉纠错”的泥潭中。

影子工作流:被掩盖的“隐形成本”

要理解这个悖论,我们需要走进一家大型连锁超市的采购办公室。根据AI模型预测,下周某款网红“爆鱼罐头”的需求将增长 20%。系统基于历史销售曲线、天气数据甚至是社交媒体的情绪分析,给出了完美的补货建议。

这是“数学上的最优解”。

然而,坐在屏幕前的资深采购经理并没有点击“确认”。他手动把补货数字改回了原样,甚至比平时更低。

为什么?因为老张知道一个模型不知道的信息:下周当地有一场大型城市马拉松赛事。

系统的算法精准地捕捉到了“想买的人”(需求侧),因为马拉松确实会带来人流;但它唯独没算出“送不进来的货”(供给侧)。如果按照 AI 的建议补货,结果只有两个:要么货车堵在路上导致运费飙升,要么货物在赛后才送到,那时人流已散,这些罐头将沦为必须折价处理的滞销库存。

不难发现,企业花费数百万美元部署的智能系统,极易沦为昂贵的计算器。并且这种场景并非孤例,从沃尔玛的后台到街边便利店的总部,一条看不见的“影子工作流(Shadow Workflow)”正在暗流涌动。

这就是目前零售业面临的巨大隐形成本:企业以为自己购买了自动化,实际上只是购买了“建议权”。最终的决策闭环,依然依赖于人类经验构建的“影子系统”在维持运转。这种“双轨制”不仅导致了数据的割裂,更带来了一个严重的后果——信任崩塌。

一旦一线员工发现手动修改比信赖系统更安全,AI 就从“副驾驶”降级为了“干扰源”。

逻辑黑洞:为什么数学对了,生意亏了?

我们要明确一点:零售 AI 并没有失败。相反,它在算力上已经登峰造极。现在的库存模型更灵敏,对需求波动的抓取更及时,甚至能比人类更快发现某种口味薯片的流行趋势。

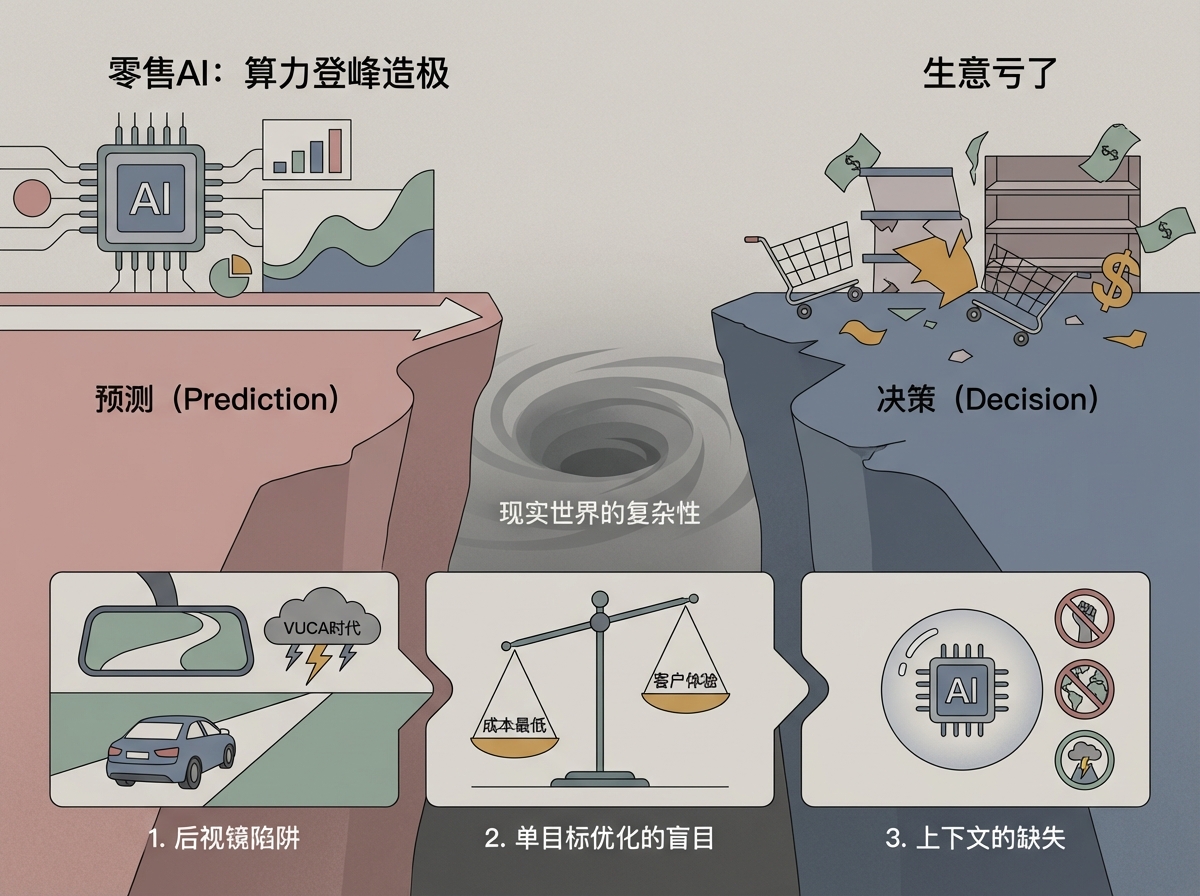

但问题在于:预测(Prediction)不等于决策(Decision)。

这两者之间隔着一道巨大的鸿沟,这道鸿沟叫做“现实世界的复杂性”。目前的零售 AI 之所以频频失灵,是因为它们陷入了三个难以逾越的“逻辑黑洞”。

1. 后视镜陷阱:当历史不再押韵

传统的 AI 预测系统,本质上是一个盯着后视镜开车的司机。它极度依赖历史数据(Historical Data)来拟合未来的曲线。在相对平稳的经济周期里,这非常有效。

然而,零售业正处于一个极端波动的周期(VUCA 时代)。地缘政治摩擦导致的红海航运停摆、气候变化引发的原材料短缺、甚至是 TikTok 上一个突然爆火的竞品视频,这些因素都是“离群点”。对于商业竞争来说,这些离群点恰恰是决定生死的“信号”。

《华尔街日报》曾深入报道过多个案例:即便拥有最先进 AI 工具的巨头,在面对突发供应链中断时,反应速度甚至不如传统的家族小店。

2. 单目标优化的盲目

这是目前算法最致命的缺陷。AI 往往被设定为优化单一变量,比如“成本最低”或“周转速度最快”。

Orchestro 创始人 Shekhar Natarajan 曾指出:“我们建立了知道如何计算、却不知道如何判断的系统。”

想象一个过度优化库存的 AI 系统。它的目标是达成“零库存”。在一次重大促销前夕,系统发现近期销量平稳,于是为了削减仓储成本,它拒绝了额外的备货申请。

- 从财务报表看,它立功了:库存持有成本降低了。

- 从品牌资产看,这是一场灾难:满心期待的客户涌入店铺,看到的却是空空如也的货架。

3. 上下文的缺失

这正是前文“马拉松案例”的症结所在,目前的 AI 很难处理训练集之外的“上下文(Context)”。

地缘政治的摩擦、当地社区的罢工风险、甚至是一个突发的公关危机,都不会出现在标准优化模型的变量里。当这些因素浮现时,AI 不会解决问题,它只会“升级异常”——把烂摊子丢回给人类。

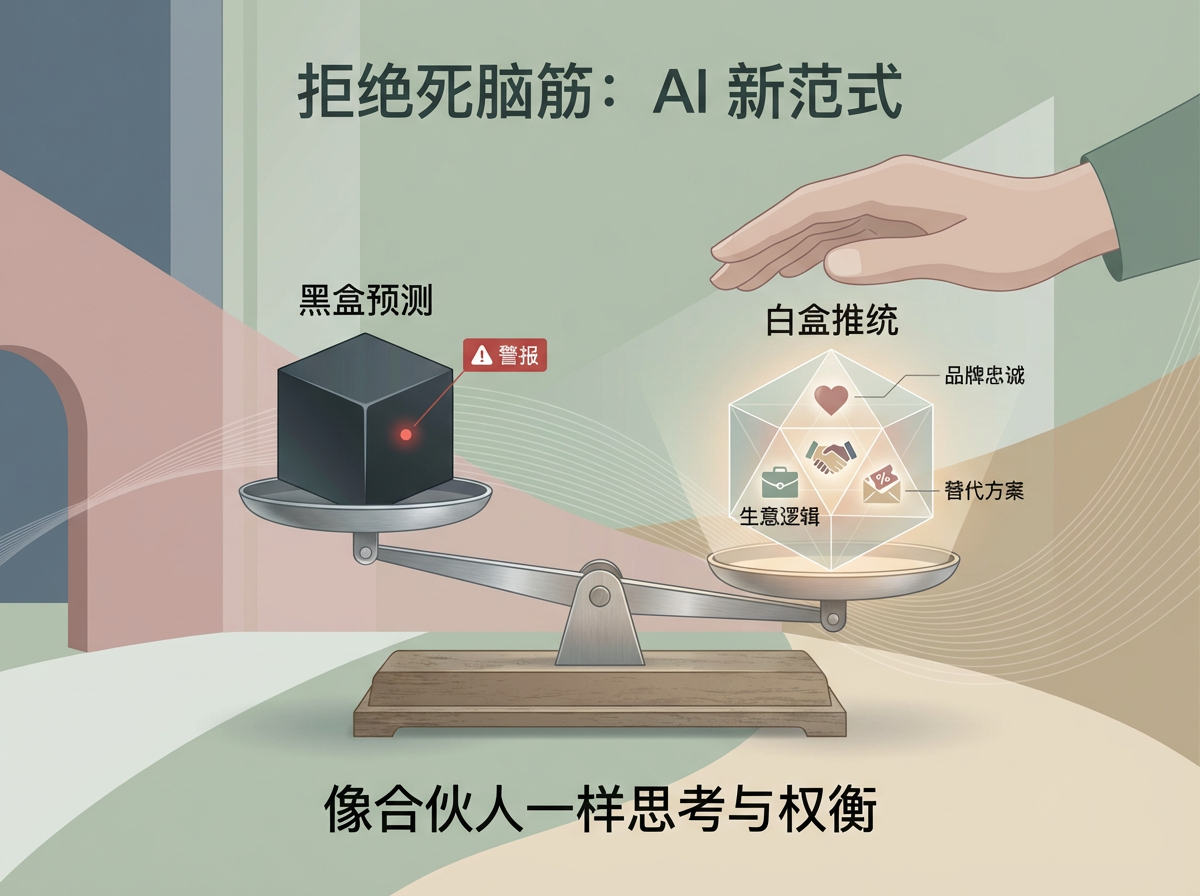

技术进化:从“黑盒预测”到“白盒推理”

面对这种困境,零售 AI 的竞赛正在进入下一个维度。在这个赛段,拼的不再是谁的模型参数更大,而是谁能完成从“预测系统”到“推理系统(Reasoning System)”的代际跨越。

这不仅仅是技术的升级,更是思维方式的革命。

1. 拒绝“黑盒”,拥抱“沙盘推演”

目前的预测系统是典型的“黑盒”:它直接扔给你一个冷冰冰的数字(例如:订货 500 箱),告诉你“大概率如此”,但不解释为什么,也不考虑后果。

而下一代推理系统(往往基于因果 AI 和代理体技术)是“白盒”。它不隐藏权衡,而是将冲突显露出来。它不再追求给出一个标准答案,而是像一个高明的参谋,为你进行沙盘推演(Simulation)。

让我们回到那个被马拉松干扰的周末。如果使用的是推理系统,它不会简单地报错或给出一个错误的数字,而是会结合外部知识库(知道有马拉松),向决策者抛出三个“平行宇宙”的剧本:

- 剧本 A(激进型): 启用空运或夜间特许通行证进行紧急补货。

- 剧本 B(保守型): 维持现状,接受缺货事实。

- 剧本 C(折中型): 少量补货,并配合营销部门向受影响客户发送致歉信及“赛后回血折扣券”。

运营者想要的从来不是另一个只会报警的仪表盘,而是一个能听懂生意逻辑、并能主动提示风险的合伙人。推理系统做的,就是把“选择权”连同“代价”一起交还给人类。

2. 理解“意图”而非仅仅是“指令”

推理系统需要理解商业行为背后的“意图”。

例如,当一项促销活动的目标被设定为“建立品牌忠诚度”而非“出清库存”时,系统的决策逻辑应该完全不同。如果遇到供应紧张,传统的优化器会停止活动以止损。

但具备推理能力的 AI 会明白,停止活动会违背“建立忠诚度”的初衷(意图),因此它会探索替代方案——比如主动建议给客户保留名额,延期发货并赠送小礼品。它保留了“目的”,而非仅仅追求“效率”。

人的新角色:从“纠错者”到“定调者”

这种技术范式的转移,迫切要求我们重新定义“人”在零售自动化中的位置。

未来的零售经理,不需要懂得如何优化神经网络的参数,也不需要像现在这样盯着 Excel 表格里的每一个数字。但他们必须懂得定义“元规则(Meta-rules)”:

- “在什么情况下,我们可以为了客户体验牺牲利润?”

- “我们的品牌底线在哪里?”

- “面对不可抗力,我们优先保护 VIP 客户还是普惠大众?”

这些带有强烈价值观倾向的判断,目前的算法完全无法理解,必须由人类注入系统。

投资人衡量 AI 价值的方式也在发生剧变。现在,华尔街不再关心你的模型准确率是 95% 还是 98%(因为边际效应已经递减),他们开始问更尖锐的问题:

- 这个决策在极端压力下能否站得住脚?

- 它是否保护了品牌核心资产?

- 一线团队是否敢于不看数据就执行建议?

零售业从来不是纯粹的效率竞赛。从根本上说,它是一个服务行业,依赖于在条件不完美的情况下,可靠地满足人类的需求。

最好的零售运营者始终明白,好的决策需要平衡:成本与服务、速度与可靠性、短期报表与长期信任。这场竞赛的获胜者,将是那些重新思考 AI 定义的公司。AI 不应是冷冰冰的自动化工具,而应进入“服务模式”。

2026 年的零售业新赛道已经开启:终点不在于创造思考得更“快”的 AI,而在于开发更懂得“权衡”的 AI。在一个波动性常态化的时代,这种信任,将决定谁能留在未来的货架上。

当算法开始懂得像老板一样思考“得失”,而不仅仅是像会计一样计算“数字”时,真正的智能零售时代,才刚刚拉开序幕。