再造一个谷歌?阿里撕掉电商外壳,“通云哥”低调出关

当大多数人还在关注春节假期的返程车票时,全球半导体与AI圈却因为平头哥官网的一次静默更新而产生了一场小型地震。

一款名为“真武810E”的高端AI芯片(PPU)悄无声息地正式上线。这颗此前仅在新闻联播画面中惊鸿一瞥、被阿里严密保护的自研核心,终于彻底揭开了神秘面纱。随着“真武”的归位,阿里巴巴筹谋已久的一张AI终极战略版图——由通义实验室、阿里云、平头哥组成的“通云哥”黄金三角,第一次完整地、呈攻击姿态地站到了全球聚光灯下。

这一动作背后的深意,远超出一颗芯片的发布。在全球科技圈,一个残酷的共识正在达成:未来的AI竞争,拼的不再是单一的大模型参数,而是“算力+算法+基础设施”的系统工程。此前,全球公认同时握有顶尖自研芯片(TPU)、世界级云平台(Google Cloud)和头部大模型(Gemini)的公司只有谷歌一家。现在,阿里成了第二个。这意味着,阿里正在试图复刻甚至超越谷歌的AI护城河,将自己从一家商业公司彻底重塑为一家底层科技算力公司。

为何全世界都在为英伟达打工?

要理解“通云哥”为何让资本市场兴奋,必须先看清当下AI行业的病灶。现在的AI开发者,无论规模大小,都深陷在一种名为算力焦虑的噩梦中。

这种焦虑的第一层是“买不到、买不起”。在过去两年里,英伟达的H100/H200系列芯片成了硅谷和中关村最硬的通货。每一枚芯片背后都包含了英伟达极高的毛利,这意味着无论是像微软、亚马逊这样的云巨头,还是满怀梦想的AI创业公司,只要你还在这个游戏里,就必须向英伟达缴纳高昂的“算力税”。

这种昂贵的租金直接锁死了大多数云厂商的利润底线,也让无数AI创业公司在模型还没跑通前就烧光了投资人的钱。

焦虑的第二层则是更深维度的“软硬失调”。这就好比你买了一辆顶级的法拉利跑车,却只能在坎坷不平的乡村土路上行驶。通用的GPU虽然强大,但它就像一把万能瑞士军刀,虽然什么都能干,但在处理特定的大模型算法(比如现在主流的MoE混合专家架构)时,往往会造成巨大的资源闲置和功耗浪费。

这种两层皮的现状,导致了算力效率的极大损耗。在摩尔定律放缓、高端芯片供应链受限的当下,谁能把每一滴算力的价值榨干,谁就握住了AI时代的定价权。阿里的“通云哥”战略,本质上就是要在这种集体焦虑中,提供一套自给自足且极致合身的解决方案。

拆解“通云哥”黄金三角的硬核战力

在这个系统中,三块拼图并非简单的叠加,而是通过软硬件深度的咬合,实现了系统级的化学反应。

- 第一块拼图:通义实验室(Qwen)——AI时代的开源大脑

作为阿里的算法中枢,通义千问(Qwen)已悄然成为全球开源模型界的无冕之王。数据是不会骗人的:截至2025年10月,千问系列模型的下载量已经超越了美国Meta公司的Llama。这意味着在全球开发者手中,千问正在成为事实上的技术标准。在Hugging Face等全球开发者社区,每天有超过200个新模型基于千问衍生。

在实际应用层面,千问已构建了庞大的生态体系。其服务不仅覆盖了OPPO、vivo等消费电子巨头,也深入了国民经济与科研的关键领域,获得了包括国家电网、中国科学院在内的众多国家级重点企业与机构的深度采用,证明了其扎实的产业价值。

- 第二块拼图:阿里云(Alibaba Cloud)——承载万卡集群的钢筋骨架

如果说模型是思想,那云就是身体。根据Gartner在2025年发布的多份权威报告,阿里云在核心云技术领域获得了全面认可:在《云原生应用平台魔力象限》和《容器管理魔力象限》两份报告中,阿里云均被评为 “领导者” ;同时,在面向生成式AI的基础设施领域,Gartner评定阿里云为 亚太地区唯一的“新兴领导者” 。这些评价体现了阿里云在全球云计算及前沿技术领域的强大竞争力。

为了承载AI时代那如洪水般涌入的计算需求,阿里云彻底重构了底层架构。其自研的HPN 8.0高性能网络,支持单集群10万卡GPU的高效互联,互联带宽高达6.4Tbps。这意味着即便上万颗芯片同时开会决策,也不会产生任何通信延迟。配合自研的CPFS并行文件存储系统,海量的数据读取瓶颈被彻底打破,为大规模模型训练提供了目前亚太地区最强大的“水电煤”保障。

- 第三块拼图:平头哥(T-Head)——定义底层的自研心脏

这次惊艳亮相的“真武810E”PPU,是阿里真正的底牌。96GB的HBM2e超大显存和700GB/s的片间互联带宽,直接瞄准了英伟达主流产品的腹地。在AI领域,显存容量决定了模型能背诵多少知识,而互联带宽决定了多颗芯片协同工作的效率。

更关键的是,这款芯片是为通义大模型量身定制的。它针对Qwen3等主流MoE架构做了大量的算子融合与指令集优化。这种“软硬一体”的深度优化,让通义大模型在真武芯片上运行的吞吐量增加了71%,而时延降低了70.6%。

塔猴点评:简单来说,阿里实现了一种AI全栈内循环。在其他公司还在被迫购买昂贵的通用零件来组装电脑时,阿里已经具备了根据软件需求去定制核心芯片的能力。这种深度定制意味着:因为每一层都是为上一层量身打造的,所以它不仅跑得比别人快,而且省去了大量中间环节的溢价和损耗,最终让AI的成本大幅下降。

为什么三位一体能让阿里重新被定价?

长期以来,市场对阿里的定价逻辑一直停留在电商巨头的范畴。人们关注的是天猫的GMV,是淘宝的月活。然而,“通云哥”的出现,正在强行修正这种刻板印象。

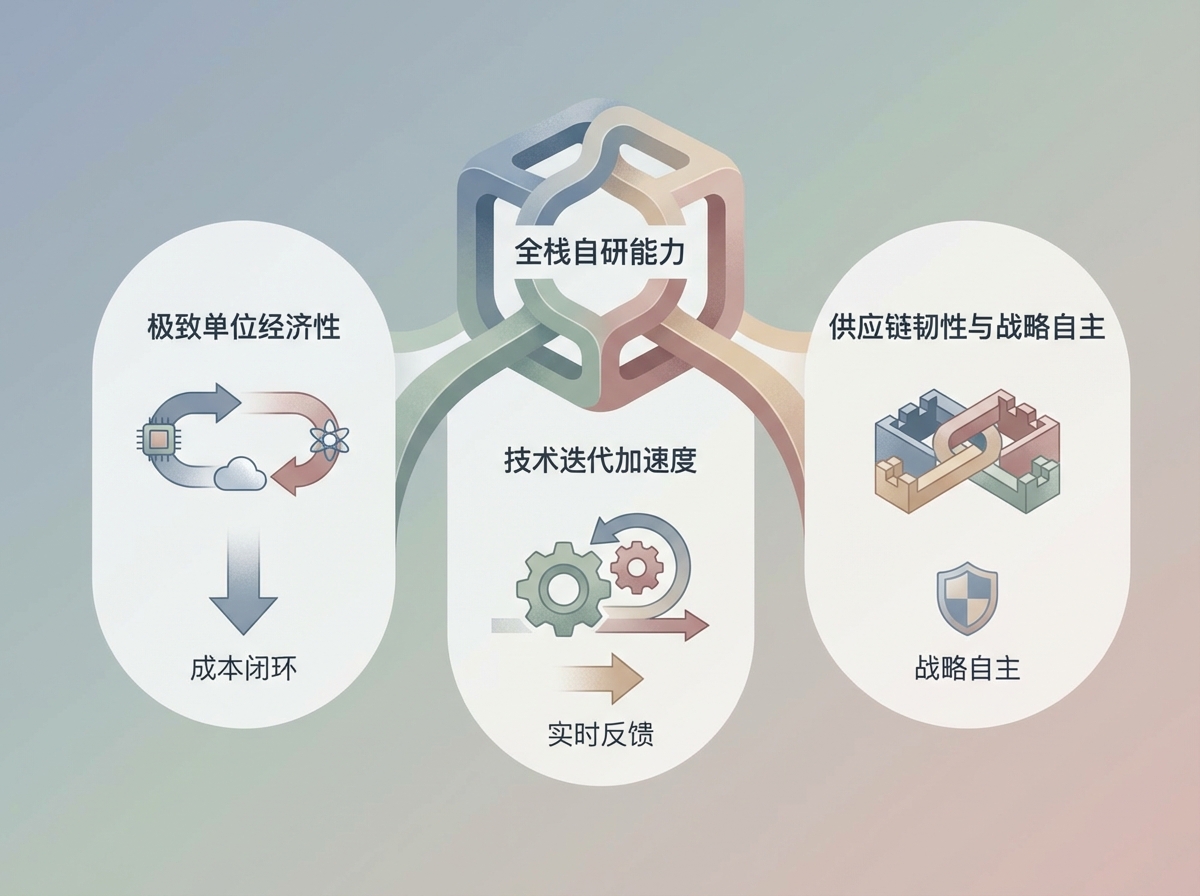

我们要思考一个商业逻辑:当一家公司同时拥有全球领先的云、自主研发的高端芯片、以及第一梯队的开源模型时,它就不再是一个简单的互联网平台,而是一艘能够实现“内部循环”的科技航母。这种全栈自研的能力,为阿里带来了三大质变,也将彻底改变其估值逻辑。

首先是极致的单位经济性。

高盛的研究指出,通过自研专用芯片(ASIC/PPU)替代通用GPU,推理成本可以下降约70%。这意味着,当其他友商还在苦哈哈地给英伟达缴纳高额利润时,阿里已经通过“自研芯片+自家云+自家模型”实现了成本的闭环。这种内部化带来的规模效应,最终会转化为产品的定价权,让阿里云在面对企业级客户时,拥有其他竞争对手无法企及的成本优势。

其次是技术迭代的加速度效应。

对于平头哥而言,自研芯片可以直接在阿里云的万卡集群中进行实战验证和快速迭代,研发周期被极致压缩。传统的模式是:芯片厂商造芯片,云厂商买芯片,模型厂商写代码。这中间存在巨大的反馈时延。但在阿里内部,这种反馈是实时的。这种“模型指挥芯片,芯片服务模型”的协同效应,让阿里云AI相关产品的收入实现了连续9个季度的三位数增长。这不仅仅是收入的增长,更是阿里从流量变现向算力变现的成功跃迁。

最后是全球供应链韧性与战略自主权。

在复杂的国际经贸环境下,算力已经成为如同石油一样的战略储备。拥有自研芯片不仅是赚多赚少的问题,而是“生死存亡”的问题。虽然在先进制程上受到一定限制,但阿里通过先进封装技术和系统级架构优化(如HPN 8.0网络),用“集体的力量”弥补了“单点的不足”。这意味着阿里掌握了AI时代最核心的“遥控器”,不再担心被外部供应链锁死喉咙。这种确定性,是资本市场在评估一家万亿级巨头时,最看重的长期安全性溢价。

这种逻辑的改变,意味着资本市场需要用评估英伟达或谷歌的逻辑来重新审视阿里。阿里正在从一家“应用层”的公司向“基础设施层”跨越。如果说过去的阿里是在别人的地基上盖楼,那么现在的阿里就是在自己制造钢筋水泥,并制定楼房的建筑标准。

决战全栈之巅:阿里如何与硅谷巨头划江而治?

放眼全球云市场,虽然亚马逊(AWS)、微软(Azure)和谷歌(Google Cloud)依然盘踞高位,但这场超级AI竞赛已经分化出了两条截然不同的路径。亚马逊和微软选择了“云+生态”的模式,它们通过深度绑定OpenAI或Anthropic,利用资本纽带快速建立护城河。这条路走得很快,但隐忧在于核心技术不在自己手里,且面临着英伟达高昂的成本锁死。

而阿里选择的是与谷歌类似的“全栈自研”苦旅。这条路最难走,需要从最底层的半导体物理、网络架构到最上层的算法模型进行全线攻关,但它一旦修成,便是最高的壁垒。

对于阿里巴巴来说,选择这条路不仅是为了商业利润,更是为了在复杂的国际局势中寻求供应链安全和生存主动权。虽然在先进制程上存在挑战,但阿里证明了通过“系统级能力”可以弥补“单点制程”的不足。通过先进封装、高性能网络架构以及软硬一体的调优,阿里成功构建了一套除了美国体系之外、全球最具竞争力的另一种AI基础设施选择。这对于许多渴望实现AI转型却又担心成本和供应风险的全球500强企业来说,具有致命的吸引力。

“通云哥”的正式成型,标志着阿里已经拿到了通往AI决赛圈的门票。在未来的全球计算版图中,这家中国科技巨头的位置将变得不可替代。它不再仅仅是一家让人买东西的公司,而是正在成为为未来AI世界铺设水电、煤气和高速公路的能源巨头。

如果金融市场依然用电商的眼光来审视阿里,那么显然错估了这头科技巨兽在AI时代的真正野心。从“通云哥”开始,阿里的估值逻辑正在被重写,而这,仅仅是这场全球算力大变局的序幕。