停止买外链!ChatGPT 正在重构流量规则,2026 年不懂这个直接出局

说句得罪全行业的话:你们公司现在花大价钱养着的 SEO 团队,如果不转型,到 2026 年基本都可以裁掉了。

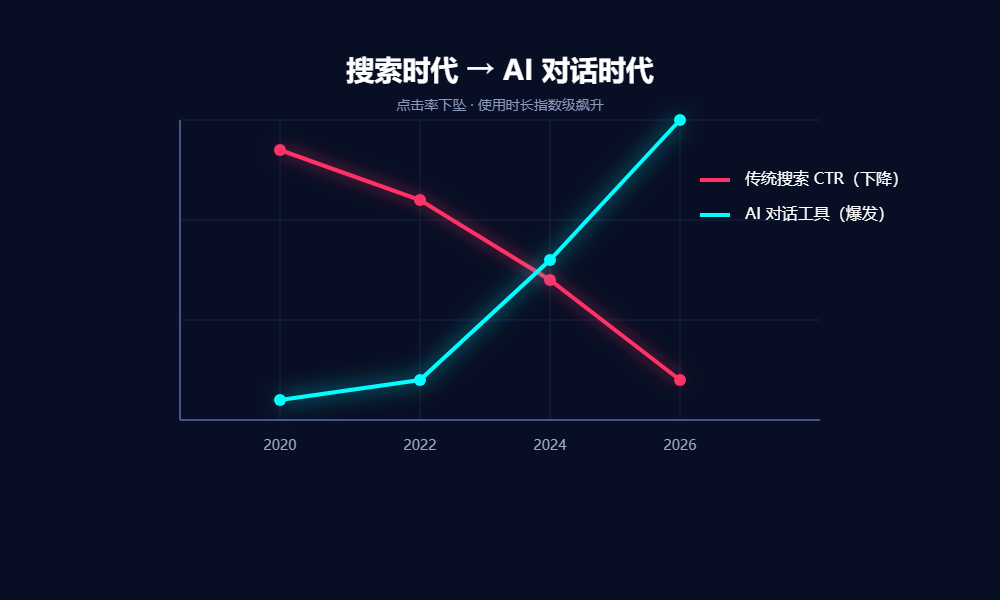

最近这一年,我接触了不下五十家 SaaS 公司的创始人、出海品牌的操盘手,大家无一例外都在抱怨一个致命问题:网站的自然搜索流量正在以肉眼可见的速度断崖式下跌。 很多人还在死磕是不是 Google 核心算法又更新了,是不是外链质量变差了。别自欺欺人了。真正的原因是:用户的搜索习惯已经被大模型(LLM)彻底重塑了。

从 ChatGPT 推出原生搜索,到 Perplexity 估值一路狂飙,再到 Google 全面铺开 SGE(生成式搜索体验)。一个残酷的现实摆在面前:用户不再经历“输入关键词 → 看十个蓝色链接 → 挨个点击网站 → 痛苦对比”这个漫长的漏斗了。现在的年轻人和高效工作者,他们直接问 AI:“帮我找个市面上最好用的无代码建站工具,要求能接 Stripe,月费不超过 20 刀,给我做个对比表。”

AI 几秒钟内生成一个完美的表格,给出推荐,用户照做。如果你不在 AI 的那个回答里,在这个新世界,你的产品就等于不存在。 传统 SEO 抢占的是“搜索页的前三名”,而 LLM SEO(大模型搜索引擎优化,或称 GEO/AIO)抢占的是“AI 大脑里的唯一正确答案”。

作为在流量圈和 AI 圈摸爬滚打多年的老兵,今天我把这套底层逻辑彻底拆碎了揉碎了讲给你听。文章很长,但如果你想在 2026 年保住你的生意,请务必一字不落地看完。

传统搜索已阵亡

很多人对“传统 SEO 已死”这句话嗤之以鼻,觉得这是贩卖焦虑。那我们就用数据说话。根据最新的行业报告,在 Google 引入 AI 概览(AI Overviews)后,部分垂直领域(特别是工具类、信息解答类)的网站自然点击率暴跌了 40% 以上。

为什么?因为 “零点击搜索” 已经成了绝对主流。

过去,你优化关键词,把密度做到 3%,买高权重的 DoFollow 外链,就是为了把官网排到第一。用户点进官网,你的销售漏斗才开始运转。

现在,大模型是一个“信息嚼碎机”。它的逻辑是:替用户去全网把你、你的竞品、各种评测文章全看一遍,提炼出结论,直接喂给用户。

我带盘子的时候经常给团队强调一个认知:不要再幻想用户会慢慢看你花里胡哨的落地页了。 你那个充满苹果风滚动特效、动效满天飞、文案全是什么“重塑未来”、“赋能生态”的官网,在 AI 眼里就是一堆难以解析的代码垃圾。

AI 需要的是硬核事实。谁能顺应 AI 的阅读习惯,谁就能拿到下一个十年的流量红利。

传统 SEO 与 LLM SEO 的核心指标对比

| 核心维度 | 传统搜索引擎优化 (Google SEO) | 大模型优化 (LLM SEO / GEO) | 操盘手点评(我的视角) |

|---|---|---|---|

| 流量漏斗 | 排名展现 → 产生点击 → 官网转化 | AI 抓取源头 → AI 直接推荐 → 用户直接使用 | 流量被截胡了,但推荐带来的转化率是传统搜索的 5 倍以上。 |

| 信任背书 | 网站权重 (DA/DR)、外链数量 | 全网提及度、跨平台共识、技术社区声量 | 以前能花钱买外链作弊,现在 AI 会做交叉比对,作弊成本极高。 |

| 内容偏好 | 长篇大论、关键词堆砌、口水话充数 | 结构化数据、Markdown文档、事实陈述、对比表格 | AI 没耐心看废话。文档写得越像机器读的,AI 越喜欢。 |

| 核心媒介 | 你自己的官方网站 | 你的官网 + GitHub + Reddit + 第三方评测 | 战场转移了。官网只占权重的 30%,70% 靠第三方真实讨论。 |

AI只认全网共识

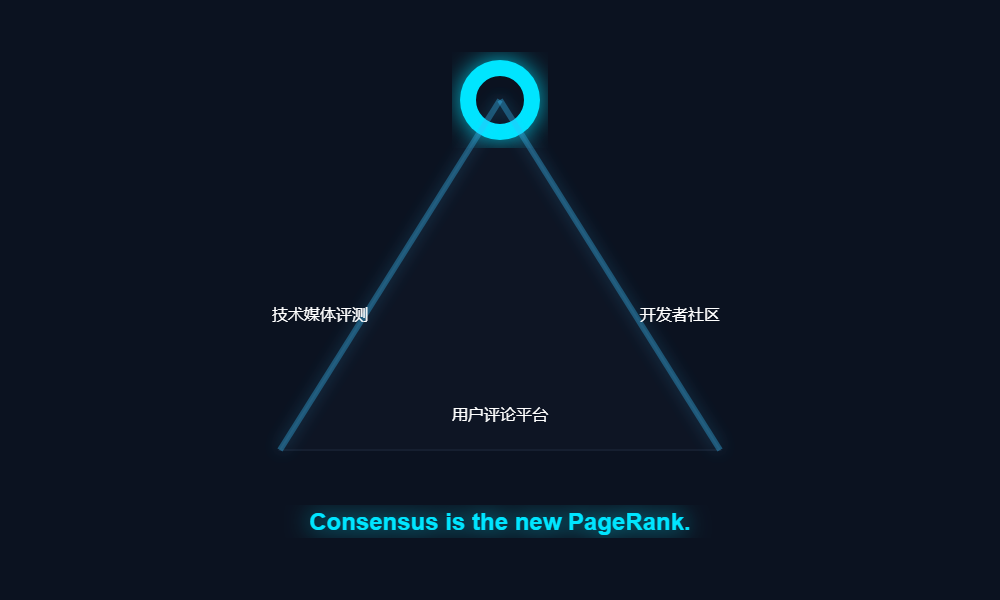

到了第一层核心逻辑:AI 到底是怎么决定推荐谁的?

很多企业主有个巨大的思维误区,他们以为在官网写上一句“我们是全球领先的 XX 工具”,ChatGPT 就会乖乖把这句话复述给用户。大错特错!现在的 LLM 都是基于 RAG(检索增强生成)技术运行的,它极其聪明,且自带“反忽悠机制”。

AI 根本不相信你自卖自夸。它知道那个 landing page 是你自己写的。AI 判定一个产品好不好的唯一标准,叫做“多源信息三角验证”。

什么是多源共识?简单来说,就是“别人替你说话”。

当用户问“推荐一个好用的项目管理工具”时,大模型会在其预训练数据和实时联网检索中寻找交集:

- 节点 A: 一家独立的技术博客写了一篇深度评测,提到了你的产品速度快。 (权重 +1)

- 节点 B: 在 Hacker News 或 Reddit 的高赞帖子里,有真实用户抱怨竞品太卡,并在评论区安利了你。 (权重 +5,极高!)

- 节点 C: 某个垂类科技媒体的年底榜单里,收录了你的名字。 (权重 +2)

- 节点 D: G2 或 Trustpilot 上的用户评论里,频繁出现“客服响应快”、“性价比高”的字眼。 (权重 +3)

当大模型发现,来自媒体、论坛、评测网的多个独立信源,都在指向同一个结论时,它才会把你的产品作为“高置信度答案”推荐给用户。

这就是为什么我强烈建议大家关注 2024 年初 Google 花了每年 6000 万美元去买 Reddit 数据访问权这个大新闻。这不只是个商业八卦,这是风向标!不仅是 Google,OpenAI、Anthropic 都在疯狂爬取高浓度的人类真实讨论。在 Reddit 上有一个热度极高的真实推荐,胜过你在官网发一百篇干瘪的 SEO 博客。

喂给AI结构化数据

懂了 AI 的评估逻辑,第二层就是怎么让 AI 能够轻松地“读懂”你。

在和很多研发团队开会时,我发现他们总觉得自己的产品天下第一,AI 没推荐是因为 AI 瞎。我打开他们官网一看,全屏的炫酷 JavaScript 动画,文字全部嵌在图片里,连个基础的 H1、H2 标签都没有。别说 AI 了,传统的爬虫抓起来都费劲。

大模型处理信息不是靠肉眼看排版,它靠的是“实体识别)”和“词元解析”。你的公司、你的产品,在全网必须是一个清晰的、标签化的“实体”。

怎么做?放弃堆砌关键词的旧套路,拥抱结构化内容。

- 全面铺设 Schema.org 标记: 这玩意儿虽然老,但在 LLM 时代焕发了第二春。告诉机器哪个是产品,哪个是价格,哪个是 FAQ,哪个是用户评价。当 ChatGPT Search 抓取你的网页时,带结构化数据的页面被引用的概率会提升 30% 以上。

- 纯文本与 Markdown 是神: 如果你的受众是开发者或 B2B 用户,请一定要提供干净的、可直接引用的文档页面。避免用复杂的 JS 渲染内容,不要把核心参数做成图片。AI 最喜欢吃什么数据?表格、列表、Markdown 格式的代码块。

- 高度的信息一致性: 这是很多人忽视的死穴。你的产品在官网上叫 “SuperTool Pro”,在 G2 上叫 “SuperTool”,在新闻稿里叫 “Super Tool AI”。对不起,在 AI 的实体知识图谱里,这会被识别成三个不同的东西,导致你的共识权重被严重分散。全网统一你的名称、核心定位和一句最精简的描述。

我曾经接手过一个做数据清洗工具的客户,他们花了很多钱投流,但 ChatGPT 死活不推荐他们。我只做了一个动作:把他们官网那堆不说人话的营销文案全删了,换成了一个巨大的、用 Markdown 写的“与竞品功能对比表”,并且在底部加了 20 个清晰的 FAQ。两周后,在 Perplexity 搜索该品类时,他们稳居推荐榜第一名。AI 就喜欢这种“喂到嘴边、嚼碎了的结构化事实”。

软文不如硬核文档

来到第三层,这也是我目前认为对技术型团队(SaaS、开源项目、工具类产品)最有价值的行动清单。

过去的营销逻辑是:PR 团队写软文 → 买媒体发布 → 拿媒体 Logo 挂在官网充门面。

在 LLM SEO 的时代,这种做法的 ROI 几乎为负。

为什么?因为 AI 的语料清洗机制极其强大,它能一眼看穿什么是“公关废话(PR Fluff)”。那些充斥着“颠覆性创新”、“行业领导者”、“矩阵化赋能”的文章,在大模型的预训练阶段就会被降权甚至过滤掉。

真正的硬通货是什么?是高质量的产品文档和开源代码库的 README。

对于工程师和技术产品来说,产品文档的质量,直接与 AI 的推荐权重挂钩。

如果你的 README 写得逻辑严密:

- 明确解决了什么痛点

- 对比其他方案的优势

- 核心功能列表

- 极简的安装启动步骤

大模型在生成答案时,会非常自然地把这些内容整段整段地“拿来主义”。我见过很多默默无闻的开源小工具,就因为 GitHub 的 README 采用了非常标准的问题解答体(Q&A style),被各种大模型当作该领域的标准答案疯狂引用,从而带动了巨大的底层自然流量。

获得一篇技术博客的真实 Benchmark(基准测试)跑分评测,或者一篇包含代码示例的使用教程,胜过你在水军网站发五十篇新闻通稿。AI 需要的是“测试过程”和“硬数据”,而不是情绪化的赞美。

布局真实的讨论区

既然 AI 讲究“多源共识”,我们怎么去创造这种共识?靠买水军行吗?

不行。很多被传统黑帽 SEO 毒害的操盘手,转头就想去机器批量发帖。但现在的 LLM 对低质量、同质化内容的识别能力非常强。你在 100 个垃圾论坛用同样的话术发帖,AI 只会提取一次,甚至会因为判定你垃圾外链过多而拉黑你的“实体”。

2026 年最贵的流量池不在搜索引擎首页,而在真实社区(Hacker News, Reddit, GitHub, StackOverflow, Quora,甚至少数高质量的 Discord/Slack 开放频道)。

在开发者社区和垂直论坛的“真实讨论曝光”,其价值远远大于付费投放。

操盘手法应该变成“埋雷与培育”:

- 创造痛点话题: 不是上去就发硬广,而是提出一个行业共同面临的痛点。

- 引入产品作为解法: 在长篇的技术讨论中,顺理成章地将你的产品作为其中一个(注意,是其中一个)解决方案提出来,并且最好带上与其他方案的客观对比。

- 鼓励核心用户发声: 如果你有铁粉用户,请引导他们在相关的 Reddit 帖子下留下一句真实的体验反馈。哪怕反馈里包含了一点小缺点也没关系!有缺点的真实评价,在 AI 眼里的置信度,远高于 100% 完美的虚假好评。

我自己的实操经验是,在 Reddit 的特定垂直节点(Subreddit)里,只要有一篇包含你产品名的帖子能够存活下来,并且产生了 10 条以上的有意义跟帖讨论,这个帖子在接下来的半年里,会被 ChatGPT 搜索引用无数次。这才是真正的长尾复利。

不同渠道对 AI 推荐权重的贡献度(行业预估)

| 渠道类型 | 代表平台 | AI 抓取与采信权重 | 优化难度 | 操盘建议 |

|---|---|---|---|---|

| 真实社区讨论 | Reddit, Hacker News | ⭐⭐⭐⭐⭐ (极高) | 高,容易被封号 | 纯人工操作,提供硬核技术价值,切忌硬广 |

| 优质独立评测 | 垂类技术博客、YouTube文字库 | ⭐⭐⭐⭐ (高) | 中 | 寄送测试账号,鼓励博主写出优缺点对比 |

| 高质量官方文档 | 官网 Docs, GitHub README | ⭐⭐⭐⭐ (高) | 低,完全可控 | 按 AI 理解逻辑重构,多用表格和 Markdown |

| 传统新闻稿 | 门户网站、软文发布站 | ⭐ (极低,甚至被过滤) | 极低 | 减少预算,AI 能够识别公关术语并将其降权 |

| 堆砌关键词页面 | 官网内容农场 (Content Farm) | ❌ (负面影响) | 极低 | 赶快停止!会被大模型判定为低质信息源 |

避开AI营销话术

如果你的文案团队还在写这种句子:“我们的产品以革命性的矩阵思维,全面赋能企业级生态,打造降本增效的闭环。”

请立刻让他们停下!这就是典型的“反 AI”内容。在 LLM 时代,产品文案的第一受众是机器。机器看不懂什么是“生态闭环”,它只会把这句话当做无意义的 Token 过滤掉。

在过去的几个月里,我用各种提示词测试过主流大模型的搜索提取能力,结论非常清晰:产品文案必须写成「AI 容易引用的陈述句和陈述事实」。

什么是 AI 喜欢的事实?

- 不要写: “世界上最快的视频渲染神器。”

- 应该写: “相较于传统的本地渲染,工具 X 利用云端 GPU 阵列,能将一段 10 分钟的 4K 视频渲染时间从 2 小时缩短至 5 分钟。”

- 不要写: “全方位保护您的数据安全。”

- 应该写: “产品 Y 采用 SOC2 认证和端到端 256 位 AES 加密技术,所有用户数据均部署在 AWS 法兰克福节点。”

发现区别了吗?具象的数据、清晰的对比、标准的行业术语(SOC2, AES),这些才是 AI 能够提取并组织成推荐理由的“锚点”。

你的任务是降低大模型的“推理成本”。你把句子写得越直白、越符合主谓宾的逻辑、数据越翔实,AI 在拼凑答案时,直接把你这句话整段照搬的概率就越大。这就是最隐蔽但也最有效的 LLM SEO 技巧。

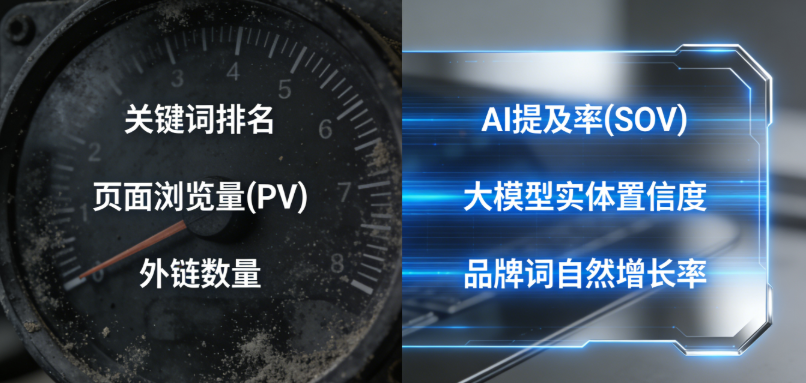

怎么衡量优化效果

肯定有同行会问:“大佬,传统 SEO 我能看站长工具,能看曝光量和点击率。现在改成 LLM SEO,大家都不点击网站了,我怎么给老板汇报 KPI?怎么衡量效果?”

这是一个非常犀利且实在的问题。当点击率(CTR)归零,我们需要新的衡量指标。目前行业内领先的团队,都在悄悄转向以下几个新维度:

- AI SOV (Share of Voice 品牌声量占比):

不要再查关键词排名了。写一系列关于你所在领域的常见提问(Prompt),比如“2025年跨境电商 ERP 推荐”。每个月,用不同的纯净 IP,分别向 ChatGPT (GPT-4o)、Claude 3.5 Sonnet、Perplexity 提问。

统计你的产品在这些 AI 的回答中出现的频率。如果 AI 推荐了 5 个工具,你有几次排在第一?有几次在列表里?这就是你的 AI SOV。 - 长尾品牌词搜索量飙升:

虽然 AI 拦截了通用词(如“好用的 ERP”)的流量,但当 AI 推荐了你的产品后,用户会对你的产品产生兴趣。你会发现,传统搜索引擎后台中,包含你品牌名(Brand Keywords)的自然搜索量会激增。这说明 AI 已经成功给你种草,用户在做最终确认。 - 引流来源的突变:

如果你在使用类似 Plausible 或 Google Analytics 的工具,你会发现直接流量或者来源不明(Referral 未知)的流量变高了,这很大一部分来自 AI 对话框里的直接点击(如果用户真的点击了你的官方引文链接的话)。

总结

最后总结一下。很多人恐惧 AI 会摧毁现有的流量分配机制。是的,旧的机制确实正在崩塌,那些靠批量生成垃圾文章、靠买黑链做站群的投机者,将在 2026 年之前彻底退出历史舞台。这不正是我们期盼已久的“内容净网行动”吗?

真正的护城河,从来不是 SEO 技巧。在 LLM 时代,大模型本质上是一个全知全能的超级裁判,它通过海量的数据运算,找出了那些**“真正被人类认可的产品”**。

记住这三把金钥匙:

① AI 推荐靠多源共识,自说自话没用,要让别人、让真实的社区替你说。

② 结构化、极简、可直接引用的事实内容,比任何华丽的营销修辞都管用。

③ 对于所有技术型产品和工程师来说:你们开源的 README,你们在社区里帮别人解答问题的真实跟帖,就是当下世界上最强大的 SEO 武器。

拥抱这场变革吧。去做出好产品,去服务好一小批核心用户,去把文档写得像艺术品一样清晰。当你把这些“慢功夫”做到极致时,大模型在浩瀚的数据海洋中,自然会将你打捞出来,推向聚光灯下。

这个时代的流量,已经不再属于那些懂算法漏洞的人;它终于开始属于,那些真正懂用户的人。