超越行为树:利用 LLM 驱动 NPC 的复杂决策链

前言:NPC 什么时候才能不“弱智”?

哈喽兄弟们,做游戏这么多年,有没有觉得我们的 NPC 其实一直都在“原地踏步”?不管美术做得多 3A,剥开皮一看,底层的逻辑还是几十年前的 FSM(有限状态机) 或者 行为树(Behavior Tree):

- 玩家进入范围 -> 追击。

- 玩家跑出范围 -> 傻站着 / 回到原点。

- 攻击玩家 -> 播放固定的骂人音频。

这种“甚至能背下来”的行为模式,在开放世界游戏里简直是沉浸感杀手。

今天我们要搞点前沿的。我们不只要让 NPC 会说话(那是入门),我们要利用 OpenAI API 和 LangChain,赋予 NPC 一个真正的“大脑”,让它能根据仇恨值(Aggro)、阵营(Faction)甚至记忆来动态决策。

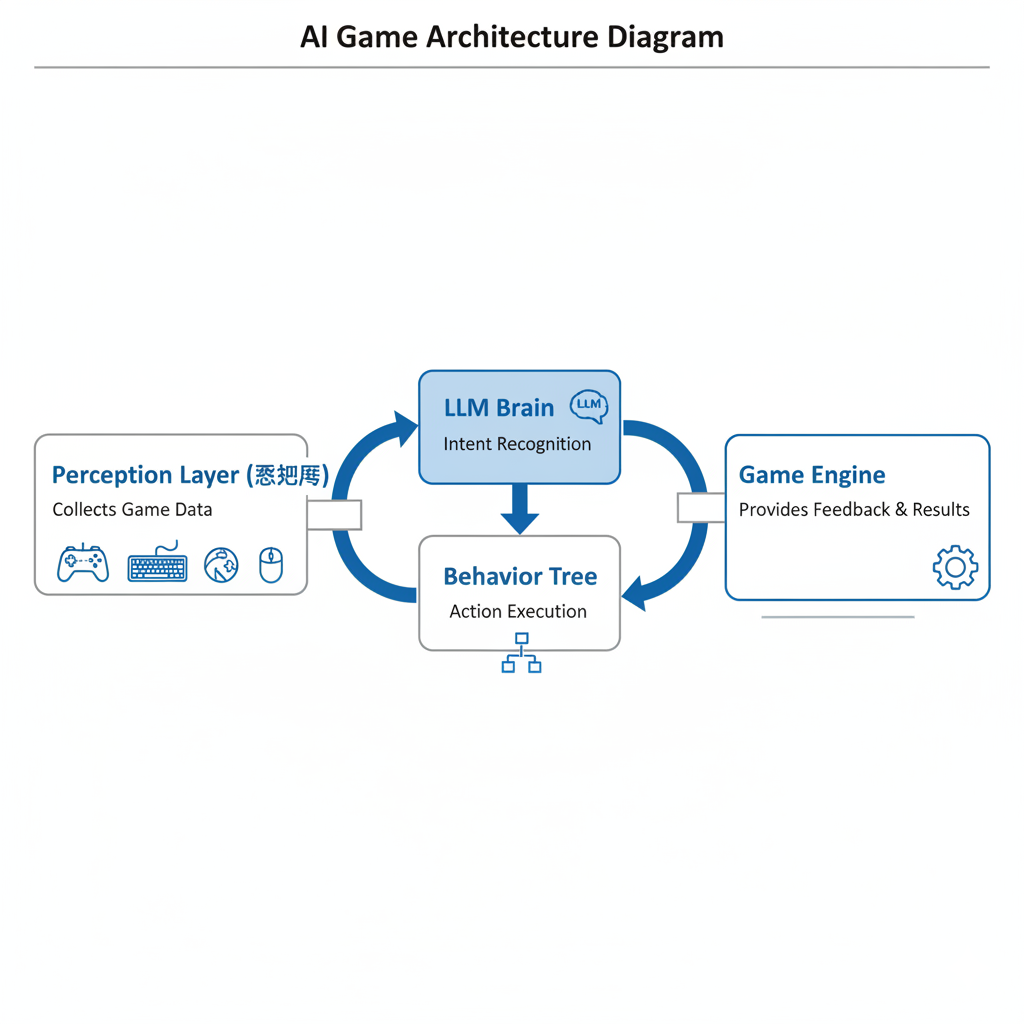

01. 架构革新:大脑(LLM)与小脑(FSM)

首先要泼盆冷水:千万别用 LLM 直接控制 NPC 的移动和开枪! LLM 的推理速度太慢了(几百毫秒的延迟),而且 Token 很贵。你让它每帧去判断“要不要开枪”,服务器会爆炸的。

最专业的架构是“双脑协同”:

- System 2(慢思考 - 大脑):LLM

- 负责战略决策。例如:“玩家刚杀了我兄弟,我现在很愤怒,我应该呼叫增援还是逃跑?”

- 运行频率:低(每 5-10 秒一次,或事件触发)。

- System 1(快反应 - 小脑):行为树/状态机

- 负责战术执行。例如:“大脑让我‘攻击’,那我执行【寻找掩体 -> 瞄准 -> 射击】的动作序列。”

- 运行频率:高(每帧 Update)。

- 图注:一张清晰的架构图。左侧是“Perception Layer(感知层)”收集游戏数据;中间上方是“LLM Brain”进行意图识别;中间下方是“Behavior Tree”执行具体动作;右侧是“Game Engine”反馈结果。

- 目的:让程序员秒懂如何将 AI 接入现有管线,而不是推倒重来。

02. 实操核心:用 Prompt 控制数值(仇恨与阵营)

LLM 最大的问题是“太不可控”。怎么让它理解游戏里的 数值? 我们需要在 Prompt 中使用 结构化数据注入(Structured Data Injection)。

场景实战:守卫 NPC 的决策逻辑

假设我们有一个守卫,我们希望他根据玩家的行为改变态度。我们不能只给 LLM 一段文字,我们要给它JSON。

构建 System Prompt:

# Role

你是一个中世纪城堡的守卫。你的性格是:多疑、忠诚、暴躁。

Game State (实时注入的参数)

- Player_Faction: "Rebel" (反叛军)

- My_Faction: "Empire" (帝国军)

- Aggro_Level (仇恨值 0-100): {current_aggro}

- Distance_To_Player: {distance} meters

Decision Rules (决策逻辑)

- 如果 Aggro_Level > 80: 必须攻击,输出状态 "COMBAT"。

- 如果 Player_Faction != My_Faction 且 Aggro_Level > 50: 警告玩家,输出状态 "WARN"。

- 如果 Aggro_Level < 20: 闲聊或无视,输出状态 "IDLE"。

Output Format (强制 JSON)

请仅输出 JSON,不要包含其他解释:

{

"thought": "玩家是反叛军,而且靠得太近了,我很不爽",

"state": "WARN",

"dialogue": "站住!肮脏的反叛军,再走一步我就砍了你!"

}

看点:我们将游戏内的硬数值(仇恨值、距离)映射成了 LLM 的逻辑判断依据。这就是“数值驱动文本”。

"thought": "这反叛军竟敢打听帝国军的事,不安好心,得警告他。",

"state": "WARN",

"dialogue": "哼!你这反叛军问这个干什么?再敢多嘴,休怪我不客气!"

}

- 注解:OpenAI Playground 或 LangSmith 的界面。

- 目的:展示 Prompt Engineering 在游戏逻辑中的具体写法。

03. 代码落地:LangChain 结构化输出

在 Unity 后端或 Python 中间件里,我们使用 LangChain 来确保输出格式的稳定性。因为游戏引擎只认代码,不认自然语言。

Python 代码片段(LangChain 实现):

from langchain.chat_models import ChatOpenAI

from langchain.output_parsers import StructuredOutputParser, ResponseSchema

from langchain.prompts import PromptTemplate

1. 定义我们想要的输出格式(给游戏引擎用的)

response_schemas = [

ResponseSchema(name="state", description="The NPC’s FSM state: IDLE, WARN, COMBAT, FLEE"),

ResponseSchema(name="dialogue", description="What the NPC says to the player")

]

output_parser = StructuredOutputParser.from_response_schemas(response_schemas)

2. 组装 Prompt

prompt = PromptTemplate(

template="… (上面的 System Prompt) … \n{format_instructions}",

input_variables=["current_aggro", "distance"],

partial_variables={"format_instructions": output_parser.get_format_instructions()}

)

3. 模拟游戏循环中的一次调用

def npc_think(aggro, dist):

model = ChatOpenAI(temperature=0.7)

_input = prompt.format(current_aggro=aggro, distance=dist)

response = model.predict(_input)

return output_parser.parse(response) # 返回标准的 Dict/JSON

结果:{‘state’: ‘COMBAT’, ‘dialogue’: ‘去死吧!’}

Tip:拿到这个 state 后,在 Unity 里直接 animator.SetTrigger(json.state),这不仅驱动了对话,还驱动了动画状态机!

- 目的:展示从 Python/LLM 到 Unity 客户端的完整链路打通。

04. 进阶玩法:记忆带来的涌现 (Emergence)

如果只是判断仇恨值,那写个 if-else 不就行了? LLM 的真正威力在于处理模糊逻辑和长期记忆。

你可以把玩家之前的行为存入 Vector Database (向量数据库)。 当玩家再次遇到守卫时,Prompt 会自动检索出:“玩家曾在三天前送给我一个苹果”。 LLM 会自动推理:“虽然他是反叛军(敌对),但他对我有恩。” 最终输出决策:state: "HESITATE" (犹豫),台词:“快走...趁长官没看见,我不杀你。”

这种涌现式的游戏体验,是传统脚本绝对写不出来的。

总结

游戏 AI 的未来,绝对不是“全盘 AI 化”,而是**“AI 辅助逻辑”**。

- 行为树保证了 NPC 不会穿模、不会卡死(下限)。

- LLM 赋予了 NPC 权衡利弊、通过对话影响剧情的能力(上限)。

兄弟们,别再写死板的 if (dist < 5) Attack() 了。试着接入一个 API,你的 NPC 可能会给你带来意想不到的惊喜。

Tags: #游戏AI #LLM #LangChain #Unity开发 #NPC交互 #PromptEngineering