谁在陪你玩游戏?揭秘《逆水寒》与《王者荣耀》背后的 AI 工业化黑科技

前言:别被“人工智障”的旧印象骗了

几年前,我们嘲笑游戏里的 AI 是“人工智障”:卡墙角、送人头、对话只会复读。但到了 2025 年,如果你还在《王者荣耀》的钻石局里觉得对面操作“如神助”,或者在《逆水寒》里被一个乞丐 NPC 怼得哑口无言,请不要惊讶——你可能正在面对中国最顶尖的 AI 算力。国内大厂(腾讯、网易)在游戏 AI 上的投入,其实远超我们的想象。他们不再把 AI 当作一个辅助功能,而是将其作为核心玩法的基石。今天,我们就把《逆水寒手游》和《王者荣耀》拆开,看看它们到底用了哪些具体的 AI 技术,以及我们普通开发者能从中学到什么。

模块一:网易《逆水寒手游》—— 全球首个“AI 原生”MMO 的底层逻辑

《逆水寒手游》之所以被称为“AI 游戏”,是因为它第一次大规模地将 LLM (大语言模型) 塞进了移动端的游戏逻辑里。这背后的功臣是网易伏羲实验室。

1. 智能 NPC:不只是聊天,是“行为驱动”

很多游戏接了 GPT 只能陪聊,但《逆水寒》的 NPC 能“办事”。

- 技术原理:大模型 (LLM) + 行为树 (Behavior Tree) 的动态绑定。

- 运行逻辑:

- 感知:NPC 识别玩家输入的文本(如“我要烧了你的房子”)。

- 推理:后台的伏羲大模型判断这句话的情感色彩(愤怒/威胁)和意图(破坏)。

- 决策:模型并没有直接生成一句废话,而是输出一个JSON 指令,修改了 NPC 的内部状态(State:

Peaceful->Hostile)。 - 执行:游戏引擎接收到状态变化,触发“拔刀攻击”的动作逻辑。

- 实操启示:做智能 NPC,不要只让 AI 输出文本 (

string),要让 AI 输出函数调用 (function call)。

- 图注:《逆水寒》NPC 决策黑盒拆解。左侧输入玩家的自然语言,中间经过 LLM 层进行意图识别(Intent Recognition)与参数提取(Slot Filling),右侧输出给游戏引擎的是具体的 Action ID(如

Action_Attack_01)和 State Change(如Favorability -50)。- 目的:直观展示“语言”是如何转化为“游戏逻辑”的,打破“AI 只能聊天”的刻板印象。

2. AI 捏脸:3DMM 技术的极致应用

玩家上传一张自拍,几秒钟就能生成一个极其相似的 3D 游戏角色。

- 技术原理:3DMM (3D Morphable Models) + 卷积神经网络 (CNN)。

- 实现步骤:

- 人脸检测:系统先识别照片中的五官关键点(Landmark Detection)。

- 参数映射:神经网络将这些 2D 关键点,映射到游戏骨骼系统的几百个滑块参数上(如

颧骨高度、下巴宽度)。 - 风格化迁移:最关键的一步。AI 会自动过滤掉真人的毛孔、痘印,只保留骨相,并套上游戏的“古风滤镜”,避免出现恐怖谷效应。

- 图注:从 2D 到 3D 的映射过程。左图为用户上传的真人自拍(Input);中图为算法提取的 68 个关键点网格(Mesh Topology);右图为最终渲染出的带古风妆容的 3D 游戏角色。重点展示了 AI 如何忽略照片光照影响,提取纯净的五官特征。

- 目的:解析网易伏羲如何解决“像本人”与“像游戏角色”之间的审美冲突。

3. AI 作词编曲:宋词复兴

玩家输入几个关键词(如“边关”、“离别”),AI 自动生成一首宋词,并由虚拟人演唱出来。

- 技术原理:NLP (文本生成) + SVS (歌声合成)。

- 难点:在于让 AI 理解“词牌名”的格律限制,以及古风唱腔的**“转音”**技巧。这通常需要针对特定数据集进行 Fine-tuning(微调)。

模块二:腾讯《王者荣耀》—— 强化学习打造的“电竞级”对手

如果说网易在搞“文科”AI,那腾讯的AI Lab 就是在搞极致的“理科”AI。他们的核心代号是**“绝悟” (JueWu)**。

1. 绝悟 AI:从“脚本怪”到“博弈大师”

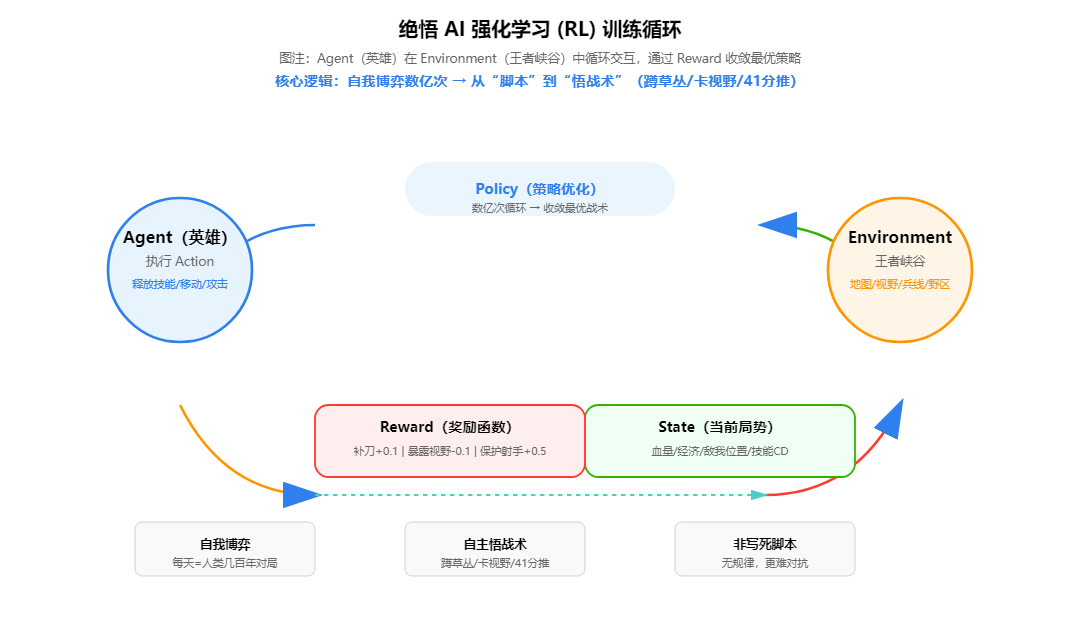

以前的 MOBA 人机是写死脚本(Scripted):血量低于 30% 就回城。这种 AI 很好抓规律。 现在的绝悟 AI 是强化学习 (Reinforcement Learning, RL) 练出来的。

- 训练逻辑:

- 环境 (Environment):王者峡谷地图。

- 奖励函数 (Reward Function):这是核心机密。不仅仅是“击杀+1分”,而是极其细碎的奖励——“补刀成功+0.1”、“在野区暴露视野-0.1”、“团战保护了射手+0.5”。

- 自我博弈 (Self-Play):让 AI 自己打自己。每天在虚拟环境里跑相当于人类几百年的对局时长。

- 表现:你会发现高难度人机懂得**“蹲草丛”、“卡视野”甚至“41分推”**。这都不是程序员写死的,是 AI 为了拿高分自己“悟”出来的。

- 图注:绝悟 AI 的强化学习闭环。Agent(英雄)在 Environment(王者峡谷)中执行 Action(释放技能/移动),获得 State(新的局势)和 Reward(金币/经验)。通过数亿次的循环,AI 逐渐收敛出最优策略(Policy)。

- 目的:用可视化的方式解释 RL 算法如何让 AI 学会战术。

2. 英雄寻路与微操:PPO 算法

为什么 AI 的韩信跳得比你准?

- 技术原理:PPO (Proximal Policy Optimization) 算法。

- 实操细节:AI 的操作频率是毫秒级的。它能精准计算技能范围和你的移动速度,打出“预判枪”。为了让玩家体验好,腾讯甚至需要人为给 AI 降智(增加反应延迟),否则人类根本赢不了。

3. 游戏环境监测:反外挂 AI

腾讯的 ACE (Anti-Cheat Expert) 系统利用 AI 识别“不自然的操作”。

- 行为序列分析:正常人的鼠标移动是有加速度和抖动的,而“自瞄挂”的移动是线性的、机械的。AI 通过分析输入指令的时间序列(RNN 模型),能精准揪出那些“看似正常实则开了挂”的玩家。

模块三:我们如何“抄作业”?

作为普通开发者,我们没有几千张显卡去训练“绝悟”,也没有伏羲实验室的算力。但我们可以用开源方案复刻 70% 的效果。

实操 1:复刻“智能 NPC” (Unity + 本地大模型)

- 工具:Unity Sentis 或 Llama-Unity-Bridge。

- 步骤:

- 去 HuggingFace 下载一个量化好的小模型(如

Qwen2.5-3B-Int4),体积只有 2G 左右,手机能跑。 - 在 Unity 中编写 C# 接口,将玩家输入的文本传给模型。

- 核心 Prompt:在 System Prompt 里写死人设:“你是一个傲娇的刺客,不要说长句子,如果玩家甚至骂你,你就回复

{Action: Attack}”。 - 解析 AI 返回的 JSON,驱动动画机。

- 去 HuggingFace 下载一个量化好的小模型(如

实操 2:复刻“强化学习 Bot” (Unity ML-Agents)

- 工具:Unity ML-Agents (免费开源)。

- 步骤:

- 搭建一个简单的竞技场(Arena)。

- 给 AI 挂载

Agent脚本。 - 写奖励逻辑:

if (击中敌人) AddReward(1.0f); if (掉出地图) AddReward(-1.0f); if (每过一秒) AddReward(-0.01f); // 鼓励快速结束战斗 - 安装 Python 环境,运行

mlagents-learn命令。 - 训练 2 小时后,把生成的

.onnx模型文件拖回 Unity,你就拥有了一个聪明的 AI 对手。

- 目的:证明普通开发者也能用低成本工具实现大厂的 AI 逻辑。

结语:AI 不是魔法,是“数据+算力”的暴力美学

通过分析《逆水寒》和《王者荣耀》,我们可以看到一个清晰的趋势: 国内大厂正在把 AI 从“营销噱头”变成“基础设施”。

- 网易 证明了 AI 可以生产内容(剧情、捏脸、语音)。

- 腾讯 证明了 AI 可以生产玩法(高强度对战、战术博弈)。

对于我们开发者来说,2025 年不需要从头造轮子。学会调用 API,学会写 Reward Function,学会用 Prompt 控制 NPC,你就能在自己的独立游戏里,复刻出大厂 80% 的 AI 体验。

参考资料与链接:

- 网易伏羲实验室官网 - 了解他们在 NLP 和 3D 视觉上的论文。

- 腾讯 AI Lab - 绝悟 (JueWu) - 关于强化学习在 MOBA 中的应用详解。

- Unity ML-Agents GitHub - 每个人都能用的强化学习工具。

- GDC 2024: AI in Justice Online Mobile - 网易在 GDC 上的技术分享复盘。

Tags: #游戏AI #逆水寒手游 #王者荣耀 #强化学习 #生成式NPC #技术拆解 #ML-Agents#